daily-coding

- JavaScript/nodejs/axios/koa

- java面试题/视频

- AI

- 面经

- mindmap

- 算法

- 目录

- JavaScript 基础

- Node.js 核心模块与原理

- Express/Koa/NestJS 中间件机制

- Java

- 1.进程和线程的区别?使用线程这能节约时间吗?

- 2.分析一下线程池的参数?线程池工作流程?四种预定义的线程池?各自的workqueue size是多少?

- 3.java怎么保持线程同步?常用的锁有什么?java锁升级是怎么样的

- 4.synchonized和lock的区别?synchonized优化

- 5.hashmap同步问题,扩容机制,怎么扩容的过程?哈希冲突哪有哪些解决?

- 6.concurrentHashmap的工作原理,数据结构?

- 7.泛型是什么?怎么实现的?

- 8.怎么理解面向对象?简单聊聊封装、多态、继承

- 9.Integer和Int的区别?什么时候用Integer?new Integer(1)会不会从缓存中取?

- 10.List为什么只能用Integer 不能用int的原因是什么?

- 11.介绍下NIO,NIO中channel的作用?

- 12.什么是乐观锁、悲观锁?区别是什么呢?原理呢?

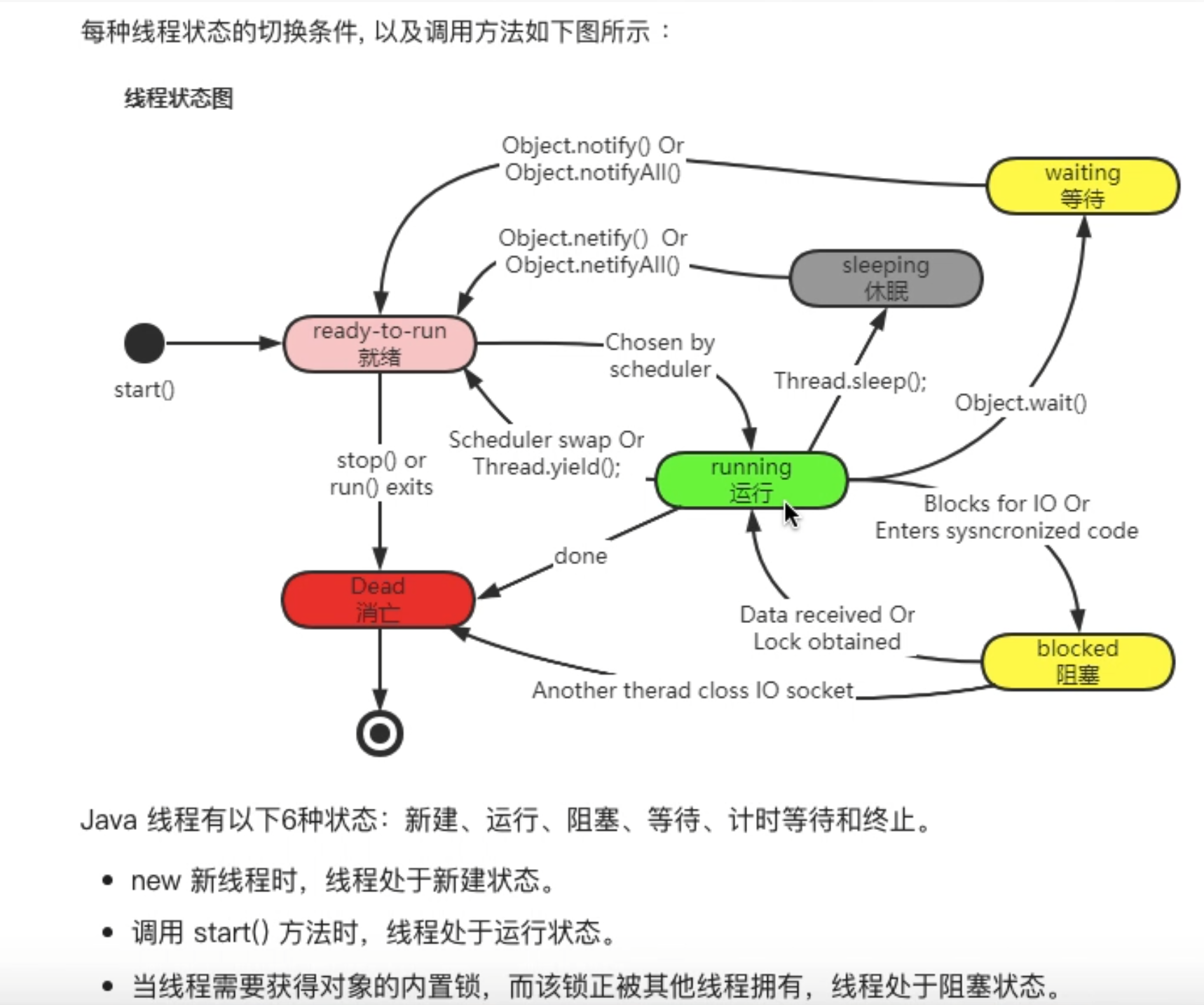

- 13、线程有几种实现方式?有什么状态?

- 14、finalize方法

- 15、说说抽象类和接口的区别。

- 16、synchonized和lock的区别?synchonized优化

- 17、为什么线程多的时候要使用锁而不是CAS?

- 18、谈一下异常,erorr和exception的区别,讲一下受检异常和非受检异常,说一下RuntimeException都有哪些,非受检异常有哪些?如何处理异常

- 19、什么是阻塞和非阻塞,什么是同步,异步?

- 20、什么是反射?反射的用途?为什么java需要反射,c++不需要。

- 21、有哪些方式可以创建一个对象?

- 22、多线程和协程的优缺点

- 23、基础类和继承类

- 24、ArrayList VS LinkedList

- 25、讲讲类的实例化顺序

- 26、JAVA有顺序的map

- 27、继承和聚合

- 28、描述动态代理的几种实现方式,分别说出相应的优缺点

- 29、为什么 CGLIB 不能代理“纯接口”?

- 30、Final的用途

- 31、给出三种单例模式

- 32、能不能只在父类写一次 hashCode() 和 equals()

- 33、设计模式

- 34、深拷贝VS浅拷贝

- 35、在自己的代码中,如果创建一个java.lang.String类,这个类是否可以被类加载器加载?为什么。

- 36、说一说你对java.lang.Object对象中hashCode和equals方法的理解。在什么场景下需要重新实现这两个方法。

- 37、实体类的equals和hashCode方法是否可以完全交给Lombok的@Data注解实现?需要注意什么地方?

- 38、那为什么 JPA 实体建议不要用 Lombok 的 @EqualsAndHashCode?

- 39、在jdk1.5中,引入了泛型,泛型的存在是用来解决什么问题。

- 40、这样的a.hashcode() 有什么用,与a.equals(b)有什么关系。

- 41、有没有可能2个不相等的对象有相同的hashcode。

- 42、Java中的HashSet内部是如何工作的。

- 43、java8的新特性。

- 44、什么是序列化,怎么序列化,为什么序列化,反序列化会遇到什么问题,如何解决。

- 45、Java基础

- 46、JAVA怎么保证线程安全?

- 47、ThreadLocal的原理?注意点

- 48、事务中的一致性和分布式系统中的一致性是一样的吗

- 49、Array的底层结构

- 50、HashMap TreeMap的底层原理,是否安全

- 51、不同JDK的特性

- 52、ConcurrentHashMap

- 53、AtomicInteger

- 54、内存溢出和内存泄漏

- 55、reentrantlock和reentrantreadwritelock的区别

- 56、线程池的原理

- 🎯 线程池(Thread Pool)的实现原理

- 57、线程池如何知道一个线程的任务已经执行完成?

- JVM

- Spring

- 1.Spring 的核心模块有哪些?IOC 和 AOP 的原理?

- 2.spring的事务传播是怎么样的,哪些方式?

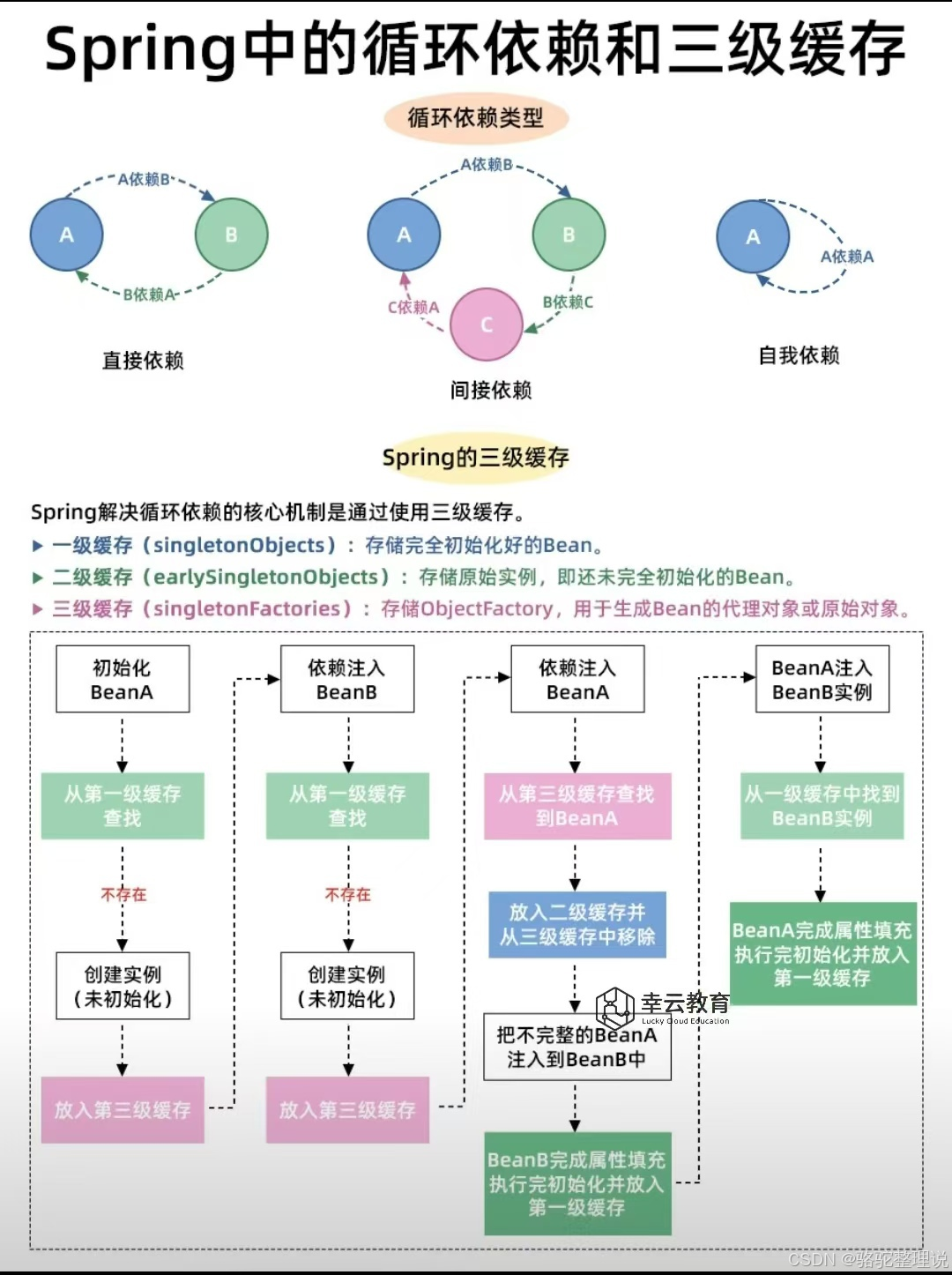

- 3.spring是如何解决循环依赖的?

- 4.@Autowired 字段注入 vs 构造器注入,循环依赖影响?

- 5.ApplicationContext.getBean() 触发循环依赖吗?

- 5. 说一下你对 Spring 的理解

- 6. Spring 的核心思想

- 7. Spring IoC 和 AOP 详细介绍

- 8. IOC 和 AOP 是通过什么机制来实现的?

- 9、依赖倒置,依赖注入,控制反转分别是什么?

- 10、AOP 在 Spring 中的应用,你知道哪些?

- 动态代理和静态代理的区别

- 11、什么是反射?有哪些使用场景?

- 12、Spring 框架中都用到了哪些设计模式

- 13、Spring 常用注解有哪些?

- 14、Spring 的事务什么时候会失效?(6 大经典失效场景)

- 15、Spring 的事件?

- 16、Bean 的生命周期说一下?

- 17、介绍一下SpringMVC

- 18、Spring bean 的作用域有哪些?

- 19.Springboot自动装配是什么

- 20、Springboot有什么启动器?

- 21、@Conditional的工作原理(运行时动态决策)

- 22、支持的内嵌容器

- 23、想手动配置一个 Bean,但又不希望 Spring Boot 的自动配置生效,怎么办?

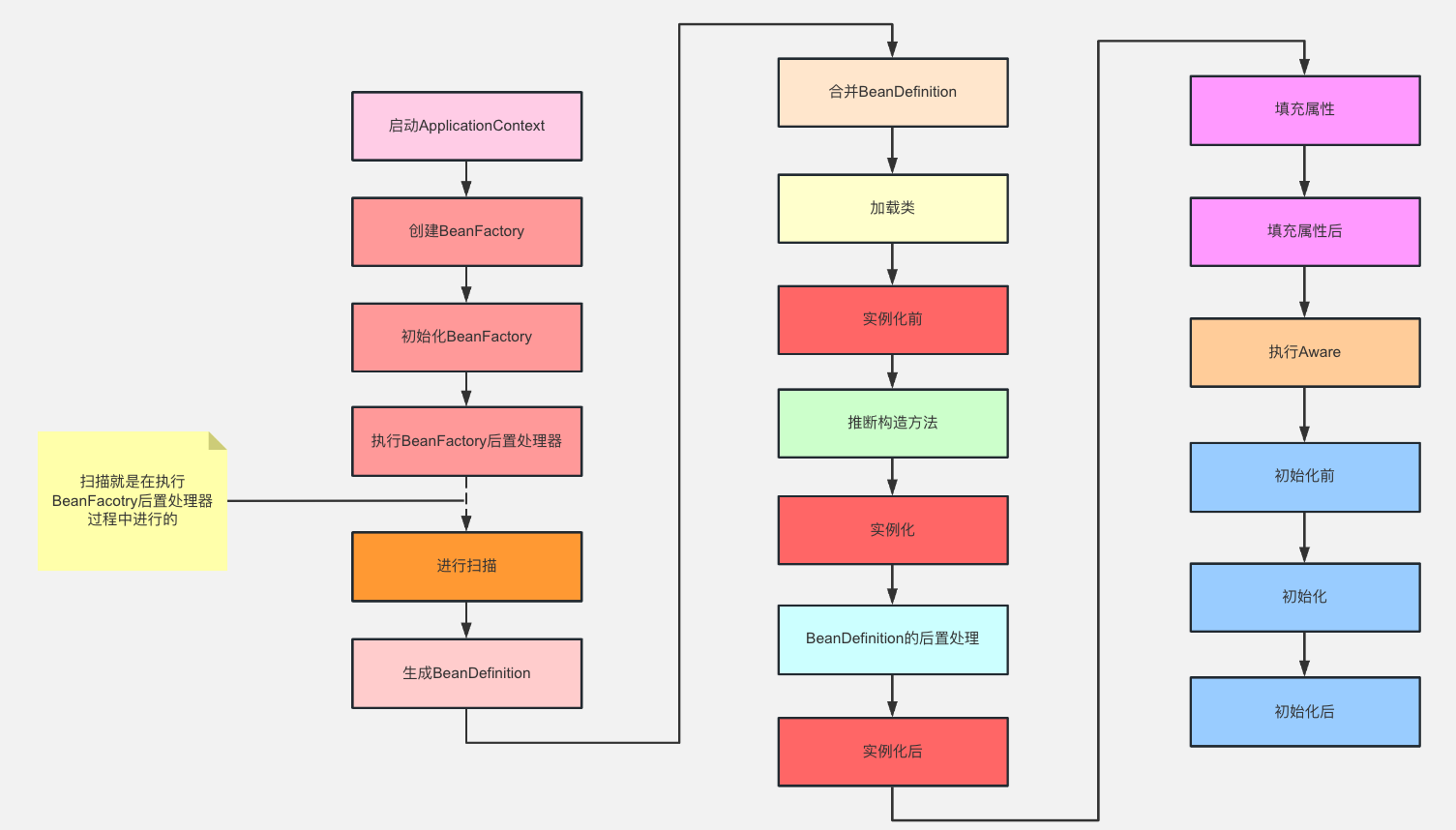

- 24、IOC容器启动流程

- 2、Spring中@Component和@Bean有什么区别?

- 3、Spring中@Resource和@Autowire的区别?

- 5、Spring Bean如何保证并发安全?

- 7、Spring面试突击:@Conditional注解有什么作用?

- 13、Spring Bean的创建顺序如何控制?

- 25、Spring Cloud 中 FeignClient 是线程安全的吗?

- 26、@Async 异步方法里能直接用 @Autowired 的单例 Bean 吗?会不会有线程安全问题?

- 网络

- Redis

- 1.Redis单线程为什么性能高?

- 2.Redis 为什么可以保证线程安全?

- 3.Redis的七大数据类型和底层数据结构?

- 4.Zset和set的区别?ZSet的底层原理是什么?

- 5.为什么使用跳表而不是B+树?

- 6.Redis的hash表是怎么扩容的?

- 7.Redis在哪些地方使用了多线程?为什么要使用

- 8.IO多路复用

- 9. 如何实现redis的原子性

- 10.除了LUA有没有其他办法实现redis原子性

- 11. redis怎么实现数据持久化

- 12.删除策略和内存淘汰策略有什么区别?

- 13.介绍一下Redis 内存淘汰策略

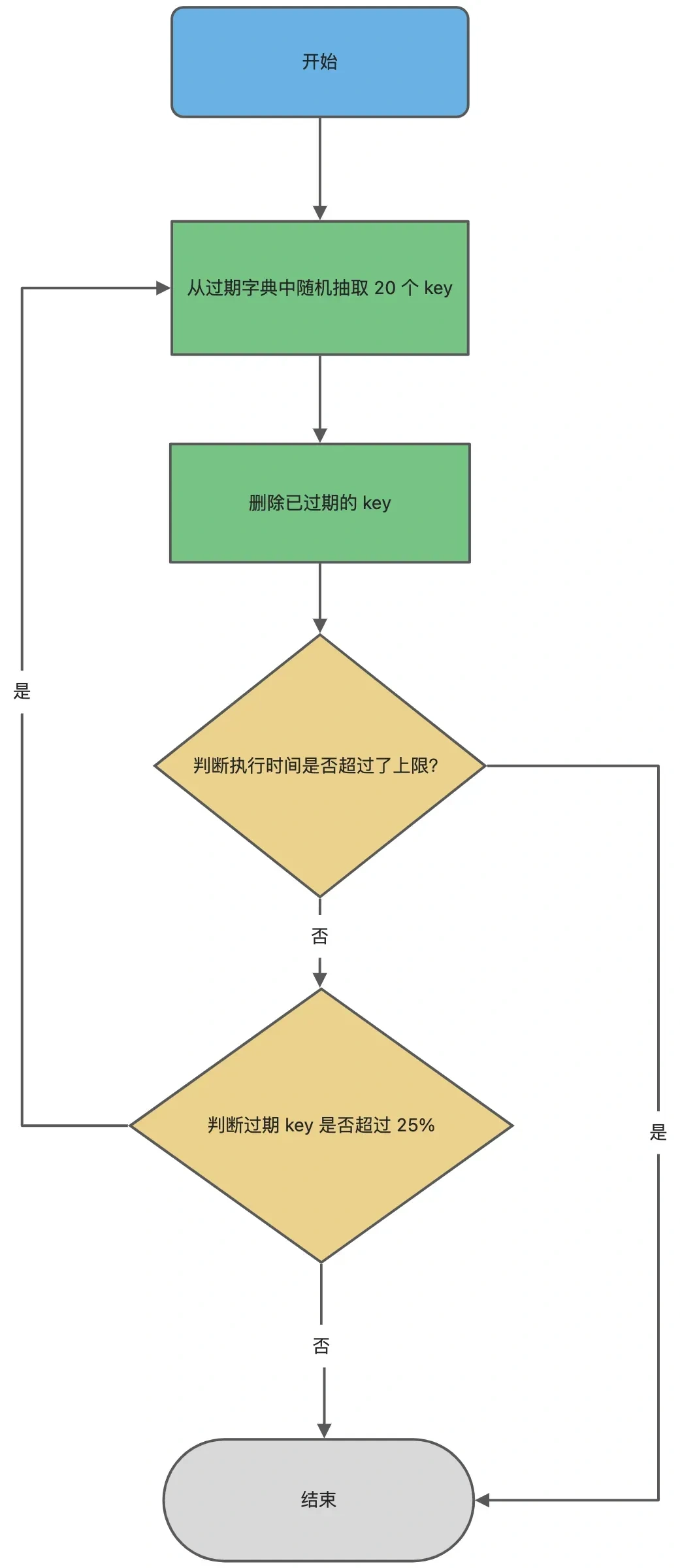

- 14.过期键删除策略

- 15.为什么不过期立即删除-需要定时器

- 16.Redis主从同步中的增量和完全同步怎么实现

- 17.redis主从和集群可以保证数据一致性吗

- 18、Redis 如何设置密码及验证密码?

- 19.集群方案

- 20、官方Redis Cluster 方案(服务端路由查询)

- 21、为什么使用redis

- 22、Redis 分布式锁的实现原理?

- 23、什么场景下用到分布式锁?

- 24、Redis 的 Key 问题是什么?

- 25、大 Key 问题的缺点?

- 26、Redis 大 Key 如何解决?

- 27、什么是热 Key 问题?

- 28、如何解决热 Key 问题?

- 29、如何保证 Redis 和 MySQL 数据强一致性问题?

- 30、缓存雪崩、击穿、穿透?怎么怎么解决?

- 31、布隆过滤器原理介绍一下

- 32、如何设计秒杀系统?对 Redis 通常并发表现?

- 33、Redis 过期策略 + 内存淘汰策略

- 34、Redis 持久化方式?优缺点?

- 35、Redis 主从复制原理

- 36、Redis 哨兵和集群的区别

- RabbitMQ

- 数据库

- 1.什么时候考虑分库分表?

- 2.mysql为什么要用b+树,不用平衡二叉树做索引结构?B树和B+树有什么区别?

- 3.创建数据库索引应该怎么考虑?

- 4.使用int 做primary key和使用string 有什么优劣?

- 5.数据库分表的方法?

- 6.如果一条SQL语句执行的很慢,怎么优化?

- 7.Mysql为什么没有使用hash索引?

- 8.索引的匹配原则知道吗?

- 16、执行计划看懂了吗?举个你优化过的索引例子

- 17、数据库的三大范式是什么

- 18、Mysql怎么连表查询?

- 19、Mysql怎么避免重复插入

- 扩展提问(面试官追问)

- 20、两条update语句处理一张表的不同的主键范围的记录,一个<10,一个>15,会不会遇到阻塞?

- 21、分库分表

- HANA

- ✅ 一、最常见基础题(必问)

- ✅ 二、SQL 与 Schema 设计(中高级)

- 3. HANA 主键使用 GUID 会不会影响性能?

- 4. HANA 是如何做索引的?需要手动建索引吗?

- 5. HANA 如何做分区?你们业务有没有分区?

- ✅ 三、性能优化(面试最爱问)

- ✅ 四、并发与锁(很容易问到)

- ✅ 五、微服务 \& HANA 整合问题(与你们项目强相关)

- 13、HANA 如何处理读写冲突?

- (1)读不阻塞写、写不阻塞读

- (2)写写冲突 → 只有一个写成功(排他锁)

- 15、HANA 避免幻读与写冲突的方式

- 16、「你们为什么要用 HANA,而不是 MySQL?」

- 17、HANA查询怎么优化

- 18、HANA事务隔离级别?怎么解决的不可重复读?

- 19、HANA 防止 SQL injection

- ClickHouse

- Kafka

- 分布式和微服务

- 架构和设计模式

- 算法

- EMS

- 1.关于操作数据库

- 2.怎么使用threadlocal

- 3、entitlement process

- 4、限制1000条,在查询时直接分页,得到返回数据查看是否超过,超过直接报错,这样只需要查一次

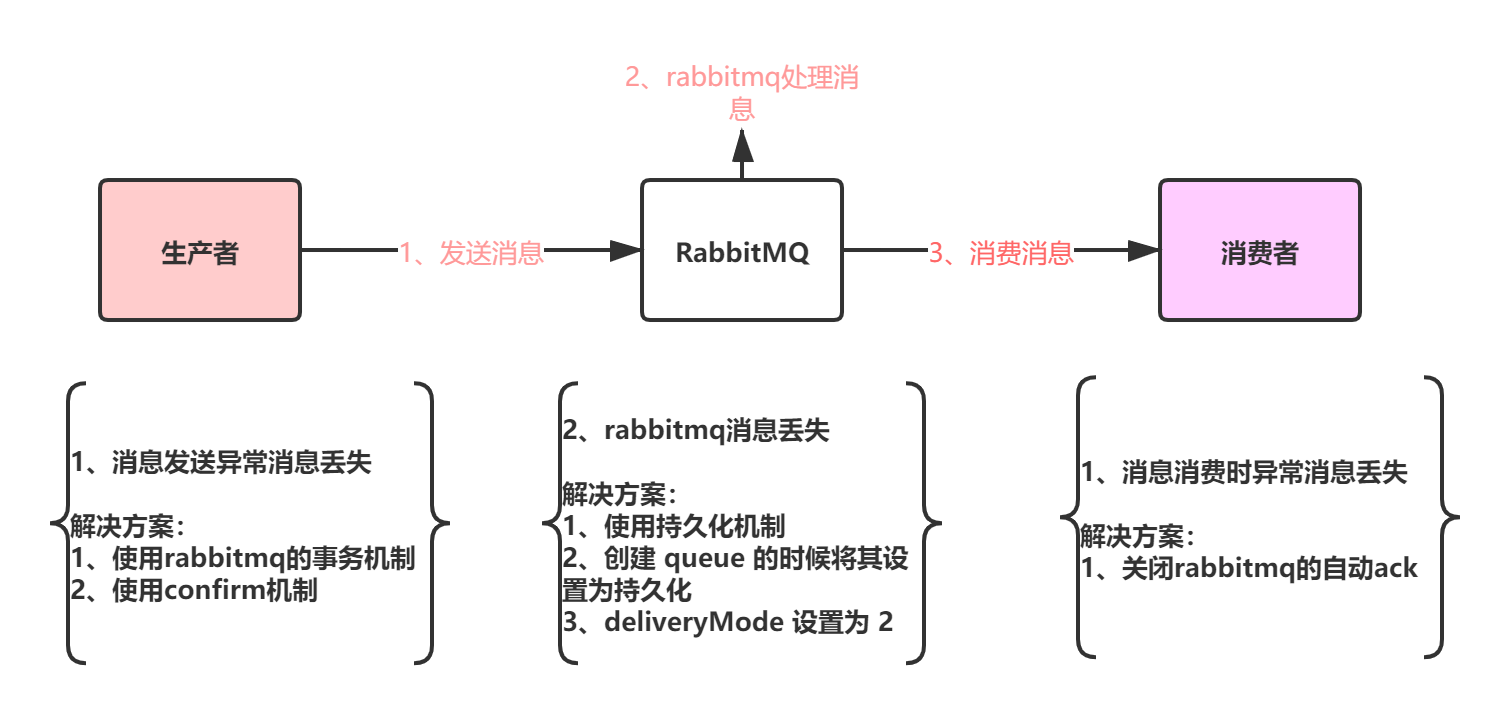

- 5、RabbitMQ 如何保证消息一定不丢?消费者失败了怎么保证数据一致性?

- 6、EntitlementProcess

- 7、表格-虚拟列映射

- 8、Entitlement 查询和更新

- 9.Database clearer

- 10.代码分析

- 11、事务一致性

- 12、动态数据源切换

- 13、如果 RabbitMQ 积压 10 万条消息,你怎么处理?

- 14、顶级追问:DB 和 RabbitMQ 同时宕机,重启后怎么保证 Outbox 消息一定能发出去?

- 15、LLM 计算

- 1. 成功率 $95%+$ 是如何计算的?

- 2. Prompt 里使用了 Function Calling 还是纯文本?

- 3. 如何防止 LLM 生成恶意代码?

- 追问:如果用户输入“删除所有权益”,模型生成的脚本真删了,你怎么防?

- 16、假设现在要给你们权益系统加一个新功能:支持“权益定时生效/失效”(比如某个许可证2025-12-31 23:59:59失效)。 日活5000万,权益总量10亿条,怎么设计?要求不能影响现有查询性能。

- 核心设计:Redis ZSET 时间轮 + 读写分离

- 4. 应对 10 亿条数据的数据库优化

- 17、限流

- 1. Redisson (分布式限流) 负责“全局配额”

- 核心机制:分布式令牌桶/计数器

- 2. Resilience4j (单机保护) 负责“单机自我保护”

- 核心机制:熔断器、重试、限流、舱壁

- 17.1 保证令牌桶全局一致性的方案

- 方案推测:Redisson RRateLimiter

- 自研 Lua 脚本(如果不用 Redisson)

- 2. 令牌生成速率和发放速率的计算

- A. 令牌生成速率(Rate)

- B. 令牌发放速率(Consumption)

- C. Resilience4j 的配置集成

- 第一层:RateLimiter(流量守门员)

- 第二层:Bulkhead Semaphore(资源隔离舱)

- 第三层:CircuitBreaker(系统级熔断)

- 第四层:TimeLimiter + Retry(请求级兜底)

- 18、Postman script gen

- 19. Rag向量划分

- 20、

- 21、共享全局上下文+前置载要

- 22、RAG

- PS:

- 1.为什么使用GUID-UUID v4

- 2.线程池

- 1️⃣ Spring Boot 常用线程池场景

- 2️⃣ 典型线程池配置示例(Spring Boot)

- 3️⃣ 项目中线程池使用场景总结

- 1.怎么防止XSS攻击

- Open Redirect

- 1️⃣ 技术栈回顾及可能遗漏的点

- 2️⃣ 你提到的具体问题分析

- 3️⃣ 面试准备方向建议

- SAP Innovation Management (SAP IM) 平台开发与实施

目录

[TOC]

JavaScript 基础

事件循环(Event Loop)详细解释一下,宏任务微任务分别有哪些?Promise 属于微任务还是宏任务?

JavaScript 运行机制的核心(JS 是单线程的,必须靠它来处理异步)。

- 同步任务:在主线程上执行,形成执行栈(Call Stack)。

- Event Loop 流程:

- 执行主线程所有同步代码。

- 执行完后,检查微任务队列。

- 清空所有微任务(同步执行)。

- 如果需要渲染,执行浏览器渲染流程。

- 检查宏任务队列。

- 取出一个宏任务执行。

- 重复步骤 2-6(循环)。

- 宏任务 (Macrotasks/Tasks):

setTimeout,setInterval,setImmediate(IE/Node), I/O 操作, UI 渲染,postMessage, Node.js 的fs模块操作。 - 微任务 (Microtasks):

Promise.then/catch/finally,MutationObserver(DOM 变动观察), Node.js 的process.nextTick。 - Promise 属于微任务:Promise 的执行体(Executor)是同步执行的,但

.then()、.catch()、.finally()注册的回调是微任务。

async/await 的底层实现原理?和 Promise 的关系?出现异常怎么捕获?

async/await 是 Promise 和 Generator 的语法糖,以同步方式书写异步代码。

async 函数返回一个 Promise 对象。await 关键字用于等待 Promise 解决,如果 Promise 被拒绝,则抛出异常。

async/await 的底层实现类似一个状态机,基于 Generator 函数和自动执行器(如 TJ 的 co 库):

async函数体内的await相当于Generator的yield,暂停执行。- 执行器负责推进

Generator(next()),并将yield后面的 Promise 链式执行。 - 当 Promise 解决后,执行器恢复

Generator,并将结果作为await的返回值。

闭包的实际应用场景?如何避免内存泄漏?

闭包依赖于 JS 的作用域链和垃圾回收机制(GC)。GC 通常在函数执行完且没有引用指向其作用域时回收内存。闭包通过保持外部作用域的引用,阻止了 GC 回收外部变量。

应用场景:

- 私有变量/封装模块:模拟私有属性,实现面向对象。

- 柯里化(Currying)/函数式编程:创建预设参数的函数。

- 防抖/节流:保存定时器 ID 和状态。

- 事件监听器中的回调:回调函数持有外部变量(如事件 ID)。

避免内存泄漏:

- 主动解除引用:在使用完毕后,手动将持有闭包引用的变量设为

null。 - 使用

removeEventListener:对于事件监听器,确保在组件销毁时移除监听器。 - 避免在闭包中引用大型 DOM 元素:容易造成循环引用。

原型链、proto、prototype 的区别?手写一个简易的 new 操作符

- 如何判断一个对象是另一个对象的实例?(

instanceof或Object.getPrototypeOf()) -

顶层原型是什么?(

Object.prototype) prototype:只有函数拥有的属性。它指向一个对象,这个对象就是该构造函数创建的实例的原型。存放实例共享的方法和属性。__proto__:所有对象都拥有的属性(现代 JS 中应使用Object.getPrototypeOf())。它指向创建该对象的构造函数的prototype。- 原型链 (Prototype Chain):由一系列通过

__proto__连接起来的原型对象组成。当访问对象属性或方法时,如果对象本身没有,就会沿着__proto__链向上查找,直到找到或到达链顶(Object.prototype,其__proto__为null)。

手写防抖和节流(必须手撕)

- 防抖 (Debounce):核心是维护一个定时器

timerId。每次事件触发时,都先清除前一个定时器,再设置一个新的定时器。确保只有最后一次触发的事件生效。 - 节流 (Throttle):核心是维护一个标志位

canRun或记录上次执行时间lastTime。确保在指定时间间隔内,函数只执行一次。

let、const、var 的区别?暂时性死区了解吗?

var:- 作用域:函数作用域或全局作用域。

- 变量提升 (Hoisting):声明会被提升到作用域顶部,但赋值留在原地(默认

undefined)。 let:- 作用域:块级作用域(

{}内部)。 - 无提升/暂时性死区 (TDZ):声明不会被提升。在块作用域内,从进入作用域开始到

let声明语句执行前,访问该变量会抛出ReferenceError。 const:- 作用域:块级作用域。

- 无提升/TDZ:与

let相同。 - 不可变性:声明后必须立即赋值,且不能再次赋值(指针不可变)。但如果指向的是对象或数组,其内部属性是可变的。

第一部分:JavaScript 核心与异步模型

Q1. JavaScript 是单线程的,如何实现并发?请解释 Event Loop 的核心工作原理。

| 核心概念 | 答案要点 |

|---|---|

| 单线程 | JS 引擎(如 V8)只有一个主执行线程 (Call Stack),负责执行同步代码。 |

| 并发基础 | 依赖于宿主环境(Node.js 或 浏览器)提供的 异步非阻塞 I/O 能力。 |

| Event Loop | 执行栈 (Call Stack) 执行同步任务;遇到异步任务(如 setTimeout, HTTP 请求),将其交给 Node APIs(或 Web APIs)处理。 |

| 任务队列 | 当异步任务完成,其回调函数会被放入 任务队列 (Task Queue) 中。Event Loop 持续检查 Call Stack 是否为空,一旦为空,就将任务队列中的回调函数推入 Call Stack 执行。 |

| 宏任务与微任务 | 微任务 (Microtasks)(如 Promise.then, process.nextTick)的优先级高于 宏任务 (Macrotasks)(如 setTimeout, I/O),会在每次 Event Loop 阶段切换之前被清空。 |

Q2. 闭包 (Closure) 是什么?它的用途和潜在风险?

| 核心概念 | 答案要点 |

|---|---|

| 定义 | 闭包是函数和该函数声明时所处的词法环境 (Lexical Environment) 的组合。简单来说,就是内部函数可以访问并记住外部函数作用域的变量。 |

| 用途 | 1. 创建私有变量和方法(封装);2. 保存状态(将函数作为参数传递时,状态被保留);3. 柯里化 (Currying) 和偏函数。 |

| 潜在风险 | 内存泄漏 (Memory Leak):如果闭包捕获了外部作用域的大对象,并且该闭包的生命周期很长,会导致外部作用域的变量无法被垃圾回收机制 (GC) 释放,造成内存占用持续增加。 |

Q3. Promise, async/await 如何解决回调地狱?它们的底层关系是什么?

| 核心概念 | 答案要点 |

|---|---|

| 回调地狱 (Callback Hell) | 传统回调函数嵌套过多,导致代码难以阅读和维护。 |

| Promise | 引入了链式调用 (then),将异步操作的状态(pending, fulfilled, rejected)标准化。Promise 本质上是将异步操作包装成同步流程的抽象。 |

| async/await | 是 Promise 的语法糖。await 关键字暂停 async 函数的执行,等待 Promise resolve。它使得异步代码看起来像同步代码,可读性极高。 |

| 底层关系 | async/await 依赖于 Promise 和 Generator 函数(或状态机)。所有 await 后的表达式,都会被隐式地转换为 Promise。 |

第二部分:Node.js 核心机制与性能

Q4. 详细描述 Node.js Event Loop 的六个阶段(JDK 1.8+ 优化后的)?

| 阶段 (Phases) | 主要工作 | 特别说明 |

|---|---|---|

| Timers | 执行 setTimeout 和 setInterval 的回调。 |

只有当时间到达,且 Event Loop 进入该阶段时才执行。 |

| Pending Callbacks | 执行系统操作(如 TCP 错误)的回调。 | 很少与应用代码直接相关。 |

| Idle, Prepare | 内部调用,用于 Node.js 内部准备工作。 | |

| Poll (轮询) | 等待 I/O 事件,执行 I/O 回调(如 TCP/UDP/FS)。如果任务队列为空,Event Loop 可能在此阶段阻塞等待新事件。 | |

| Check | 执行 setImmediate() 的回调。 |

setImmediate 类似于 setTimeout(fn, 0),但在 Event Loop 中有专门的阶段。 |

| Close Callbacks | 执行 socket.on('close', ...) 等关闭事件的回调。 |

|

| 微任务 (Microtasks) | process.nextTick() 和 Promise.then() |

优先级最高:在每个阶段切换之前,微任务队列会被清空。 |

Q5. 为什么说 Node.js 适合 I/O 密集型任务,但不适合 CPU 密集型任务?如何解决 CPU 瓶颈?

| 核心概念 | 答案要点 |

|---|---|

| I/O 密集型 | 适合。Node.js 的非阻塞 I/O 模型,基于 Event Loop 可以在等待 I/O 时继续处理其他请求,CPU 利用率高,吞吐量大。 |

| CPU 密集型 | 不适合。CPU 密集型任务(如复杂计算、大量数据加密)会长时间占用唯一的 JS 主线程,导致 Event Loop 阻塞,所有请求(包括 I/O 和新 HTTP 请求)都会被挂起,表现为服务假死。 |

| 解决方案 | 1. 集群 (Cluster):使用 Node.js 内置的 Cluster 模块,通过多进程来利用多核 CPU。2. 工作线程 (Worker Threads):Node.js 10.5+ 引入的机制,允许创建真正的子线程来执行 CPU 密集型任务,不阻塞 Event Loop。3. C++ 插件 (Addons):将 CPU 密集型代码用 C++/Rust 编写并编译为原生模块,利用底层多线程。 |

Q6. CommonJS (CJS) 和 ES Module (ESM) 的主要区别是什么?Node.js 目前的使用趋势如何?

| 特性 | CommonJS (require) | ES Module (import) |

|---|---|---|

| 加载方式 | 同步加载(适用于服务器环境,文件都在本地)。 | 异步加载(适用于浏览器和 Node.js 新规范)。 |

| 执行时机 | 运行时加载:require 可以在代码的任何地方使用,且支持动态路径。 |

静态解析:import 语句在代码执行前完成解析,利于工具链优化(如 Tree-Shaking)。 |

this 指向 |

模块内 this 指向 module.exports。 |

模块内 this 严格为 undefined。 |

| Node.js 趋势 | 兼容性模式。Node.js 正在大力推进 ESM 规范,推荐新项目使用 .mjs 或在 package.json 中设置 type: "module"。 |

第三部分:高阶 API 与实践

Q7. Stream (流) 在 Node.js 中的优势和作用是什么?列举常见的类型。

- 作用:用于处理大量数据,或数据分块处理的场景(如文件 I/O、网络通信)。

- 优势:内存效率。不需要将整个文件或数据加载到内存中,而是以小块 (chunk) 的方式处理,极大地减少了内存消耗,适合处理大文件。

- 常见类型:

- Readable (可读流):数据源,如

fs.createReadStream()。 - Writable (可写流):数据目的地,如

fs.createWriteStream()。 - Duplex (双工流):既可读又可写,如 TCP Socket。

- Transform (转换流):数据读入后经过处理再输出,如 Gzip 压缩。

- Readable (可读流):数据源,如

Q8. 什么是 Node.js 的“僵尸进程” (Zombie Process) 和“孤儿进程” (Orphan Process)?如何处理?

- 孤儿进程 (Orphan):父进程在子进程结束前退出,子进程会被 init 进程(或 systemd)收养,并正常执行直到结束。

- 僵尸进程 (Zombie):子进程结束了,但其父进程还没有调用

wait()或waitpid()来获取子进程的退出状态,导致子进程的进程描述符仍保留在系统中。 - Node.js 处理:在 Node.js 中使用

child_process创建子进程时,父进程必须监听子进程的exit事件,并在子进程退出后进行清理操作,避免产生僵尸进程。如果使用 Cluster 模块,Node.js 已经内置了子进程的管理和清理机制。

Node.js 核心模块与原理

require 加载模块的完整过程?CommonJS 和 ES Module 的区别与如何共存?

Node.js 是单线程还是多线程?那它怎么处理高并发?

进程和线程的区别?child_process 的四种方式分别什么场景用?

cluster 模块原理是什么?如何实现负载均衡?

Buffer 和 String 的区别?Buffer.concat 实现原理?

Stream 四种流的区别?可读流有哪两种模式?背压机制怎么解决?

Express/Koa/NestJS 中间件机制

Express 和 Koa 的最大区别?Koa 中间件洋葱模型手绘执行顺序

手写一个简易的 Koa 中间件(比如日志、鉴权)

NestJS 的依赖注入和 AOP 怎么实现的?拦截器、守卫、管道的执行顺序?

Java

1.进程和线程的区别?使用线程这能节约时间吗?

-

进程是操作系统进行资源分配和保护的独立单元,而线程是程序执行和调度的基本单元,是进程内的一条执行路径。

-

容器与微服务的视角

在我们熟悉的Cloud Foundry微服务架构中,可以这样理解:

维度 进程(Process) 线程(Thread) 本质 操作系统进行资源分配和保护的独立单元。一个独立的JVM实例,拥有完整的私有内存空间(堆、栈、元空间等)。 CPU调度和执行的基本单元。一个进程内的一条独立执行流,共享进程的堆内存和方法区,但拥有自己的栈和程序计数器。 资源隔离 强隔离。如同我们在Cloud Foundry上部署的一个独立的微服务实例。每个进程有独立的内存空间、文件句柄、网络端口。一个进程崩溃不会影响其他进程。 共享资源。如同一个微服务实例内部的多个@Async任务或WebFlux的Event Loop线程。共享所属进程的堆内存(即共享Spring的ApplicationContext、Bean实例、静态变量等)。一个线程崩溃可能导致整个JVM进程退出。 创建开销 大。需要分配独立的内存空间、加载类、初始化Spring容器等。这好比在CF上cf push一个新应用实例,需要走完整的构建、部署流程。 小。在已初始化的JVM和Spring容器内创建,共享已加载的类。如同在已运行的Pod内启用新的@Async线程,效率极高。 通信方式 复杂。需要IPC,如REST API、gRPC、消息队列(RabbitMQ)。这就是我们微服务间的通信方式。 极简单。直接通过共享的堆内存读写同一个对象(如一个 ConcurrentHashMap或AtomicInteger)。但必须使用synchronized、Lock、volatile等机制保证可见性和原子性。类比 一个独立的微服务实例(如 user-service实例)一个微服务实例内部的一个并发任务(如处理一个HTTP请求的Tomcat线程)

-

-

节约时间

-

对于计算密集型任务,目标是利用多核实现并行来压缩计算时间。

- 使用线程数接近CPU核数的线程池(如

Runtime.getRuntime().availableProcessors()),避免过度切换。

- 使用线程数接近CPU核数的线程池(如

-

对于I/O密集型任务,目标是利用并发来填充I/O等待时间,提高CPU利用率和系统吞吐量。

- 利用I/O等待时间。当线程A在等待用户服务响应时,CPU可以切换到线程B去处理商品服务请求,压榨CPU空闲时间。

-

特性 CPU密集型 (CPU-Bound) I/O密集型 (I/O-Bound) 核心特征 任务执行速度主要受限于CPU的运算能力。 任务执行速度主要受限于输入/输出操作的速度。 耗时大头 进行大量计算、逻辑处理、数据转换。 等待网络响应、数据库查询、磁盘读写、消息队列消费。 资源瓶颈 CPU核心数、主频、缓存。 网络带宽、磁盘I/O、数据库连接池、外部服务RT。 -

多线程:操作系统级线程(OS Thread),由内核调度,数量通常几百~几千就炸,上下文切换贵(微秒级),阻塞 = 真阻塞。

-

协程:用户态轻量线程(User-space Thread),由语言运行时调度,可轻松创建几十万~百万,切换成本纳秒级,阻塞是“假装阻塞”(实际是挂起协程)。

-

场景 推荐方案 理由 CPU 密集型(计算) 传统线程(绑定 CPU 核数) 协程不会比线程更快,GIL/单核切换反而慢 IO 密集型(网络、数据库) 协程 / 虚拟线程 10 万连接下内存和延迟完胜 已经基于回调/Reactor Netty + Reactor 成熟生态,改造成本低 想用同步代码写异步逻辑 Java 虚拟线程 / Go / Kotlin 代码看起来像单线程,调试、日志、异常栈都友好 追求极致性能 Go Goroutine GMP 模型 + 网格式调度器,当前最强协程实现 Java 项目升级最省力 JDK 21+ 虚拟线程 只需要把 new Thread() 改成 Executors.newVirtualThreadPerTaskExecutor() -

排名 场景 传统多线程写法 2024~2025 推荐写法(协程/虚拟线程) 真实占比 1 异步发日志 / 埋点 / 审计 @Async + TaskExecutor 虚拟线程(几乎零改造) 90% 2 异步发送邮件 / 短信 / 站内信 @Async 虚拟线程 85% 3 定时任务(Corn / 动态定时) @Scheduled(fixedRate) 虚拟线程 + ScheduledExecutor 80% 4 批量导入 / 导出(Excel、CSV) 多线程分片 + CountDownLatch 虚拟线程 StructuredTaskScope(JDK21) 75% 5 高并发对外 HTTP 接口(10w+) Tomcat + 线程池 Netty + WebFlux 或 虚拟线程 60% 6 消息队列消费(RocketMQ/Kafka) @RocketMQMessageListener 虚拟线程消费(2024 年新趋势) 50% 7 限流熔断降级(Sentinel) 内部就是线程池 虚拟线程 + Resilience4j 40% 8 网关层(Spring Cloud Gateway) Netty + Reactor 已经默认协程(Reactor),未来可换虚拟线程 100% -

@Async 里面调用同一个类的普通方法为什么不生效? → Spring AOP 是基于代理,this 调用绕过代理

-

虚拟线程能不能用线程池? → 可以,但推荐 newVirtualThreadPerTaskExecutor()(无界队列)

-

WebFlux 和虚拟线程能共存吗? → 可以,底层都是 Reactor,但代码风格完全不同

- 什么时候必须用 WebFlux? → 已经全站响应式 + 需要背压

CPU 密集型: 线程数应该少而精,配置为 CPU 核数 + 1。目的是减少上下文切换,让 CPU 专注计算。传统线程(绑定 CPU 核数)

I/O 密集型: 线程数应该多而广,通常是 2 * CPU 核数,或者是根据 $N \times (1 + \frac{等待时间}{计算时间})$ 公式计算。目的是在线程等待 I/O 时,让 CPU 切出去处理其他线程,榨干 CPU 剩余价值。协程 / 虚拟线程

-

2.分析一下线程池的参数?线程池工作流程?四种预定义的线程池?各自的workqueue size是多少?

ThreadPoolExecutor executor = new ThreadPoolExecutor(

int corePoolSize,//核心线程数

int maximumPoolSize,//最大线程数

long keepAliveTime,//线程空闲存活时间

TimeUnit unit,//时间单位

BlockingQueue<Runnable> workQueue,//工作队列

ThreadFactory threadFactory,//线程工厂

RejectedExecutionHandler handler//拒绝策略

);

2.1工作流程

- 提交任务

- 核心线程是否已满?

- 否–即使有线程空闲,也会立即创建一个新的核心线程

- 是,下一步

- 工作队列是否已满?

- 否,放入工作队列等待执行

- 是,下一步

- 线程数是否达到最大值

- 否,创建一个创建一个新的非核心线程执行任务

- 是,下一步

- 触发拒绝策略

- 线程和队列都已饱和,无法处理新任务,调用rejectedExecutionHandler处理这个被拒绝的任务

2.2四种预定义线程池的区别和workqueue的大小

| 类型 | 核心队列(workQueue) | 队列容量/最大线程数 | 典型使用场景 & 优缺点 | |

|---|---|---|---|---|

| FixedThreadPool 固定大小线程池 |

LinkedBlockingQueue<Runnable> |

无界(Integer.MAX_VALUE) 固定(newFixedThreadPool(n)) |

• 适用于任务量可控、需要限制并发数的场景(如数据库连接池) • 优点:线程数稳定 • 风险:任务堆积 → OOM |

|

| CachedThreadPool 可缓存线程池 |

SynchronousQueue<Runnable> |

容量 0(无缓冲) 无上限(Integer.MAX_VALUE) |

• 适用于大量短生命周期任务(如 Web 请求处理) • 优点:响应极快,自动扩缩容 • 致命风险:任务突刺 → 线程爆炸 → OOM |

|

| SingleThreadExecutor 单线程化线程池 |

LinkedBlockingQueue<Runnable> |

无界(Integer.MAX_VALUE) 永远 1 个线程 |

• 适用于任务必须串行执行的场景(如日志写入、顺序敏感操作) • 优点:天然线程安全 • 风险:任务堆积 → OOM |

|

| ScheduledThreadPool 定时周期性任务线程池 |

DelayedWorkQueue(内部优先队列) |

无界 固定(核心线程数) |

• 专门用于定时任务 & 周期性任务(ScheduledExecutorService) • 支持 schedule、scheduleAtFixedRate、scheduleWithFixedDelay |

2.3线程工厂

- 用于创建新线程的工厂类。

- 可以定制线程的名称、优先级、是否为守护线程等属性。

面试高频补充

- 最容易 OOM 的两个线程池:

FixedThreadPool和SingleThreadExecutor→ 无界队列,任务堆积 → 内存泄漏CachedThreadPool→ 无界线程数,任务突刺 → 线程爆炸

- 生产推荐做法:

// 推荐:自定义 ThreadPoolExecutor,显式指定队列大小

new ThreadPoolExecutor(

corePoolSize,

maxPoolSize,

keepAliveTime,

TimeUnit.SECONDS,

new LinkedBlockingQueue<>(5000), // 有界队列,防止 OOM

threadFactory,

new ThreadPoolExecutor.CallerRunsPolicy() // 饱和策略

);

ThreadPoolTaskExecutor executor = new ThreadPoolTaskExecutor();

// 如果您不设置任何参数,直接调用 executor.initialize(),则采用以下默认值:

// executor.setCorePoolSize(1); // 危险!核心线程只有1个

// executor.setMaxPoolSize(Integer.MAX_VALUE); // 极度危险!线程数无上限

// executor.setKeepAliveSeconds(60); // 空闲线程60秒后回收

// executor.setQueueCapacity(Integer.MAX_VALUE); // 极度危险!使用无界队列

// executor.setThreadNamePrefix("SimpleAsyncTaskExecutor-");

// executor.setRejectedExecutionHandler(new ThreadPoolExecutor.AbortPolicy()); // 队列满后抛异常

3.java怎么保持线程同步?常用的锁有什么?java锁升级是怎么样的

Java 通过 synchronized、Lock(ReentrantLock)、原子类(CAS)、volatile、并发容器、线程安全工具等实现线程同步;

1>常用锁

1. 内置锁(synchronized)

- 特点:隐式获取和释放锁,可重入,非公平锁(Java 1.6 后默认偏向锁 / 轻量级锁)。

- 适用场景:简单同步场景,代码简洁。

2. 显式锁(Lock 接口)

- ReentrantLock:可重入锁,支持公平 / 非公平模式,可手动控制锁的获取和释放。

- ReentrantReadWriteLock:读写分离锁,允许多个读线程同时访问,写线程独占访问。

- StampedLock:支持乐观读,性能优于读写锁。

3. 其他锁类型

- 自旋锁:线程循环尝试获取锁,避免线程上下文切换。

- 悲观锁 / 乐观锁:悲观锁(如

synchronized)假设冲突一定会发生,乐观锁(如 CAS)假设冲突很少发生。 - 公平锁 / 非公平锁:公平锁按请求顺序获取锁,非公平锁允许插队(性能更高)。

2>Java 锁升级机制(synchronized 优化)

Java 1.6 对 synchronized 进行了优化,引入了锁升级机制,从低到高依次为:偏向锁 → 轻量级锁 → 重量级锁,以减少锁竞争的开销。

1. 偏向锁

- 适用场景:只有一个线程访问同步块。

- 原理:锁对象的 Mark Word 记录持有锁的线程 ID,后续该线程进入同步块时无需 CAS 操作,直接获取锁。

- 优势:消除无竞争情况下的锁获取开销。

2. 轻量级锁

- 适用场景:多个线程交替访问同步块(无激烈竞争)。

- 原理:线程在栈帧中创建锁记录(Lock Record),通过 CAS 将锁对象的 Mark Word 更新为指向锁记录的指针。

- 自旋:获取锁失败时,线程会自旋(循环尝试)而非阻塞,减少上下文切换。

3. 重量级锁

- 适用场景:多个线程同时竞争锁(激烈竞争)。

- 原理:升级为操作系统级别的互斥锁(Mutex),失败的线程会被阻塞,进入内核态等待。

- 劣势:存在内核态 / 用户态切换开销,性能较低。

锁升级过程总结:

无锁 → 偏向锁(单线程) → 轻量级锁(多线程交替) → 重量级锁(多线程竞争)

- 注意:锁升级是不可逆的(只能升级,不能降级),以保证性能。

4.synchonized和lock的区别?synchonized优化

| 特性 | synchronized | Lock(ReentrantLock) |

|---|---|---|

| 定义 | Java 关键字,属于 JVM 层面 | java.util.concurrent.locks.Lock 接口,需要手动 lock() / unlock() |

| 加锁/释放方式 | 自动加锁、自动释放(离开作用域即释放) | 必须手动调用 lock() 加锁,unlock() 释放(通常放在 finally 中) |

| 灵活性 | 不灵活,锁的获取和释放只能在同一代码块内 | 非常灵活: • 可以跨方法/跨线程加锁解锁 • 支持 tryLock() 非阻塞获取• 支持超时获取 |

| 等待是否可中断 | 不可中断(线程会一直阻塞) | 可中断:lockInterruptibly() 在等待时可被 interrupt() 打断 |

| 公平锁支持 | 只支持非公平锁(默认) | 都支持:new ReentrantLock(false) → 非公平(默认,性能更好)`new ReentrantLock(true) → 公平锁 |

| 条件队列(Condition) | 只有一个隐式等待队列,通过 wait()/notify()/notifyAll() 操作 |

支持多个条件变量:lock.newCondition() 可创建任意多个 Condition,实现精准唤醒 |

| 锁升级路径 | 支持 无锁 → 偏向锁 → 轻量级锁 → 重量级锁 的自动升级优化(HotSpot JVM 特性) | 没有锁升级,一直都是重量级(但实际底层也是偏向/轻量级优化,只是 API 层面不暴露) |

| 异常释放 | 异常时 JVM 自动释放锁 | 异常时 必须在 finally 中手动 unlock,否则死锁 |

| 适用场景 | 简单同步场景、代码侵入少 | 高并发、需要精细控制(中断、超时、公平、多个等待队列)的复杂并发场景 |

synchronized 的“条件队列”就是对象 Monitor 里的 _WaitSet,所有调用了 obj.wait() 的线程都会被挂到这个队列里等待 notify/notifyAll 唤醒。它是 Java 最原始的条件变量实现,虽然只有一个队列,但已经完全可以实现生产者-消费者、阻塞队列等经典并发模式。

偏向锁 (Biased Locking)

- 适用场景:绝大多数时候都只有同一个线程在访问同步块,几乎没有并发。

- 原理:JVM 在对象头中记录第一次获取锁的线程 ID。该线程后续进入同步块时,无需任何同步操作,只做简单的 ID 检查即可。开销极低。

- 升级条件:当有其他线程尝试获取这个锁时,偏向锁失效,升级到轻量级锁。

轻量级锁 (Lightweight Locking)

- 适用场景:线程是交替地进入同步块(例如线程 A 刚释放,线程 B 就进去了),竞争不激烈。

- 原理:JVM 使用 CAS (Compare-And-Swap) 操作尝试将对象头中的锁指针指向当前线程的栈帧。如果失败,线程会进入自旋状态(循环等待),而不是立即阻塞。

- 升级条件:如果自旋多次仍然获取不到锁(说明锁被占用的时间较长),或者自旋的线程数过多,则升级为重量级锁。

重量级锁 (Heavyweight Locking)

- 适用场景:并发竞争激烈,多个线程同时请求锁,且锁被持有的时间较长。

- 原理:这是传统的互斥锁机制。未抢到锁的线程会被操作系统阻塞,导致线程上下文切换,开销最大。

新来的线程想抢锁

↓

_cxq(争用队列)

↓ (被Park)

锁释放时,_cxq 头节点出队 → 尝试获取锁

↓ 成功

持有锁执行...

↓ 调用 wait()

释放锁 + 放入 _WaitSet + Park (WAITING)

↓ 被 notify/notifyAll

从 _WaitSet 移到 _EntryList + Unpark

↓

继续竞争锁(BLOCKED → RUNNABLE)

1>ReentrantLock 底层怎么实现的(AQS)?

- ReentrantLock 是基于 AQS 实现的显式锁,必须手动 unlock,底层通过 volatile state + CAS + CLH 阻塞队列实现。

- 它支持公平/非公平、可中断、超时、Condition 条件等待等高级特性。

- AQS 的核心是:一个 volatile int state + 一个双向 CLH 队列,所有 JUC 锁工具类底层都是它。

- 普通同步用 synchronized,需要高级特性时才用 ReentrantLock。

ReentrantLock 的底层完全依赖一个叫 AQS(AbstractQueuedSynchronizer) 的神级框架。

AQS 是 Java 并发包(JUC)的基石,几乎所有锁(ReentrantLock、CountDownLatch、Semaphore、ReadWriteLock 等)底层都是它。

AQS 核心组成(背下来)

| 组成部分 | 作用 |

|---|---|

| volatile int state | 锁状态:0=无锁,>0=已加锁,重入时递增(ReentrantLock 就是靠它实现重入) |

| CLH 同步队列(双向链表) | 阻塞线程排队的地方,头节点是当前持有锁的线程 |

| Condition 队列(单向链表) | Condition.await() 时线程会进入这个队列(可以有多个) |

| CAS 操作 | 所有状态修改都靠 Unsafe.compareAndSwapInt 来保证原子性 |

ReentrantLock 加锁全过程(非公平锁默认流程,面试最常问)

ReentrantLock lock = new ReentrantLock(); // 默认非公平锁

lock.lock();

- 尝试 CAS 把 state 从 0 → 1

- 成功 → 直接拿到锁,设置当前线程为 exclusiveOwnerThread,结束

- 失败 → 说明已经有线程占着锁

- 检查当前持有锁的线程是不是自己(支持重入)

- 是 → state++,直接返回

- 以上都不行 → 创建一个 Node,把当前线程包装进去

- 通过 CAS 把这个 Node 加入 CLH 队列尾部(尾插法)

- 调用 LockSupport.park(this) 把当前线程挂起(真正阻塞)

- 被 unlock 的线程会通过 LockSupport.unpark() 唤醒队列头节点的下一个线程

5.hashmap同步问题,扩容机制,怎么扩容的过程?哈希冲突哪有哪些解决?

HashMap 线程不安全,多线程建议直接用 ConcurrentHashMap;

- JDK1.7 扩容死循环原理:转移元素时采用头插法,多线程时 A 线程挂起后 B 线程完成扩容改变了链表顺序,A 线程恢复后继续头插会形成环形链表,之后 get 时无限循环。JDK1.8 已改尾插法,彻底解决死循环,但仍不线程安全。

- 常见错误:很多人以为“只有扩容才死循环”,其实日常 put 也可能数据丢失(size++ 被覆盖),或者多个线程同时触发 resize 导致部分桶数组元素丢失。

| 场景 | 推荐方案(2025 年最新建议) |

|---|---|

| 读多写少 | Collections.synchronizedMap(new HashMap<>())(过时) 推荐:ConcurrentHashMap |

| 高并发读写 | 直接用 ConcurrentHashMap(性能最好) |

| 只读,几乎不修改 | new HashMap<>() + 启动时 putAll 完成后再共享 |

| 需要精确控制并发粒度 | ConcurrentHashMap 的分段 putIfAbsent 等操作 |

1.扩容机制

JDK1.8 ConcurrentHashMap 当 size ≥ threshold 时触发扩容,支持多线程并发协助扩容,采用“单槽迁移任务”机制,使用 ForwardingNode 标记已迁移槽,保证高并发下读写不阻塞。

深度剖析(带陷阱/踩坑点):

- 核心原理:

- 扩容前会创建一个 capacity × 2 的新 table

- 采用“步长 stride”划分任务,默认每个线程一次处理 16 个槽(transferIndex)

- 迁移时对每个槽加锁(synchronized(table[i])),而不是全局锁

- 迁移完的槽放一个 ForwardingNode 节点,读线程遇到它会转发到新表,写线程会帮忙迁移(扩容期间写也会协助)

- 常见陷阱:很多人说“扩容期间读写全无锁”,错!读确实无锁(volatile + ForwardingNode),但写和迁移是加槽锁的。

2.哈希冲突怎么解决

主流两种:开放寻址法(线性探测、二次探测)和拉链法(链表+红黑树)。JDK1.8 HashMap 用拉链法,链表长度≥8且 table≥64 时转红黑树。

深度剖析(带陷阱/踩坑点):

- 开放寻址法(ThreadLocal 用)

- 线性探测:容易产生聚集(cluster),删除要用墓碑标记,(ThreadLocal 用)

- 二次探测:步长是平方,仍然有聚集问题

- 再散列:多个哈希函数,实际工程很少用

- 拉链法(HashMap 默认)

- 优点:简单、易扩展、删除方便

- 缺点:极端冲突时退化成 O(n),JDK1.8 引入红黑树优化尾部冲突

- 面试官最爱挖的坑:

- “你说红黑树更快,那为什么不一开始就用红黑树?” → 答:链表在冲突少时缓存友好性更好,红黑树节点占内存是链表 2-3 倍。

- “树化条件到底是 8 还是 7?” → 严格是 8(binCount >= 8),但源码里是 >7 触发树化,原因是泊松分布下冲突达到 8 的概率已极低(千万分之一)。

- 为什么 ThreadLocalMap 不用拉链法而用开放寻址? → ThreadLocal数量少(几十个),冲突概率极低,开放寻址更快+省内存

- 开放寻址负载因子为什么不能太高? → 超过0.7后聚集效应爆炸,查找退化到O(n)

- 删除开放寻址法的元素时为什么不能直接置null?举个例子说明会出什么问题?

- 核心原理:查找停止条件只有两种

- 找到 key → 返回

- 遇到 null(空槽)→ 停止查找,说明不存在 所以中间一旦出现 null,整个后面的探测链就全断了!

- 核心原理:查找停止条件只有两种

6.concurrentHashmap的工作原理,数据结构?

JDK8+ ConcurrentHashMap 完全抛弃了 1.7 的 Segment 分段锁,

用 table 数组 + CAS + synchronized 局部锁 实现高并发。

数据结构:

- 底层仍是 table 数组(volatile Node<K,V>[] table)

- 单个桶:普通链表 Node → 长度≥8 且 table≥64 转红黑树 TreeNode

- 扩容时出现 ForwardingNode(hash = -1)占位

- JDK21 新增 ReservationNode(hash = -3)用于 compute 类操作预占位 核心并发控制:初始化用 CAS(sizeCtl 从 0 → 正数),put/get 无锁或只锁桶首节点,扩容支持多线程协作。

6.1核心要点

1>put 流程(30 秒画完的经典八股)

- key 为 null → 直接抛 NPE(不允许 null key)

- 计算 hash:spread 方法(高16位异或低16位,防低位冲突)

- table == null 或对应桶为空 → CAS 插入(tabAt + CAS)

- 桶首节点 hash == -1 → 说明正在扩容 → 调用 helpTransfer 帮忙

- 否则 synchronized(桶首节点 f) {

- 如果仍是 f(没变)→ 链表插入或树插入

- 链表长度到 8 → treeifyBin(可能转树) }

- addCount(1) → 更新 size,可能触发 transfer() 扩容

5>get 流程(真正无锁读!)

- 全程无锁,靠 volatile 语意

- 如果遇到 ForwardingNode → 转发到 nextTable 继续查

- 红黑树走树查找逻辑

6>注意

-

为什么 synchronized 只锁桶首节点而不是整个桶? → 因为每次扩容迁移后首节点会变,锁住旧首节点无意义;锁新首节点即可保证同一桶串行

-

get 为什么可以完全无锁? → table 数组 volatile + Node 的 next/val volatile + ForwardingNode 转发

-

为什么不允许 null key/value? → null 被用来表示“槽为空”或“正在扩容”,无法区分

-

size() 返回的是精确值吗? → 不是!是 baseCount + CounterCell[] 分段计数,最终 sum() 可能有微小误差

-

JDK21 为什么新增 ReservationNode? → 解决 computeIfAbsent 并发时重复计算的问题,先占坑

-

addCount 里为什么用 CounterCell 分段计数?baseCount 不够吗?

-

baseCount 只适合低并发,高并发下大量线程同时 addCount(1) 会疯狂 CAS 失败重试,性能崩。 CounterCell 是分段计数(类似 LongAdder),每个线程尽量写自己的槽,极大降低竞争,最后 sum() 才汇总。

- 低并发:baseCount 直接 CAS 更快

- 高并发(64线程):CounterCell 比 baseCount 快 5~10 倍

-

项目 baseCount CounterCell[] 低并发(1~4 线程) 直接 CAS 累加,最快 有数组创建开销,反而慢 高并发(64+ 线程) 所有线程猛 CAS 一个变量,虚假冲突严重 每个线程写自己槽,几乎无竞争,性能爆表 实现原理 单 volatile long,CAS 累加 继承 Striped64(LongAdder 原理),分段 + Cell size() 返回值 参与最终求和 baseCount + 所有 Cell.value 之和(可能有微小误差) 内存开销 8 字节 初始 2 个 Cell,之后按 2 倍扩张,每个 Cell 24 字节左右

-

-

如果多个线程同时第一次 put,会不会创建多个 table?

-

sizeCtl < 0 自旋 + CAS 抢 -1 + 双重检查(recheck) + finally 释放 → 100% 只会有一个线程成功创建 table,其余线程要么自旋,要么直接使用已创建好的。

-

sizeCtl 值 含义 谁设置的 备注 0 默认值,还没初始化,也没指定初始容量 构造方法 无参构造就是 0 > 0 ① 未初始化时:表示期望的容量(已取 2 的幂) ② 已初始化后:表示下次扩容阈值 构造方法 / initTable 完成 构造传 initialCapacity 就放这里 -1 正在初始化(有线程正在执行 initTable) 抢到初始化权的线程 CAS 进去 其他线程看到 -1 就自旋等待 < -1 正在扩容,低 16 位 = 正在参与扩容的线程数 + 1 扩容线程创建/加入时 CAS 修改 例如 -3 表示 2 个线程正在扩容 -(1 + nThreads) 具体计算公式 transfer() 时动态维护 特殊值 -2, -3 等 JDK17+ 扩容戳记(resizeStamp)相关 resizeStamp() 生成 高 16 位是扩容代数

-

7.泛型是什么?怎么实现的?

泛型就是让类/接口/方法在定义时不预先指定具体类型,使用时再指定类型参数,从而实现“类型安全 + 代码复用”。

// 1. 泛型类

class Box<T> {

private T data;

public void set(T data) { this.data = data; }

public T get() { return data; }

}

// 2. 泛型接口

interface MyList<E> {

void add(E element);

E get(int index);

}

// 3. 泛型方法(最灵活)

public static <T> T max(T a, T b) {

return a.hashCode() > b.hashCode() ? a : b;

}

- 泛型是JAVA编译器类型安全机制,JVM本身并不支持泛型,而是通过类型擦除在编译阶段实现。运行时不支持泛型,通过编译器擦除+signature属性+桥接方法实现编译期类型安全和运行时兼容

- List

和 List 运行时没有区别,都是List,区别只在编译期 - 泛型字母含义

- T → Type

- E → Element(集合中最常用)

- K → Key

- V → Value

- N → Number

- ? → 通配符(未知类型)

- 为什么不能new T()?

- T是未知类型,JVM无法分配内存

- 泛型数组可以创建吗?

- 不可以,new T[10]编译失败,需要用object[]强制类型转换

8.怎么理解面向对象?简单聊聊封装、多态、继承

1.编程范式:面向过程与面向对象

编程范式是程序员编写代码的 “思维方式” 和 “组织逻辑”,不同范式适用于不同场景。

1. 面向过程(Procedure-Oriented Programming, POP)

- 核心思想:以 “过程”(函数 / 步骤)为中心,把复杂问题拆解为一个个可执行的步骤,按顺序执行。

- 关注点:“怎么做”—— 关注实现功能的具体步骤和逻辑。

- 组织方式:代码由数据结构(变量、数组等)和函数(操作数据的步骤)组成,函数是核心单元。

- 优点:逻辑清晰、执行高效,适合简单、线性的任务。

- 缺点:代码复用性差、维护难度高(需求变更时需修改大量步骤)。

- 典型代表:C 语言、早期的 BASIC。

2. 面向对象(Object-Oriented Programming, OOP)

- 核心思想:以 “对象” 为中心,把现实世界中的事物抽象为对象,对象包含 “属性”(数据)和 “行为”(方法),通过对象之间的交互完成功能。

- 关注点:“谁来做”—— 关注对象的职责和交互,而非具体步骤。

- 三大核心特性

- 封装:将数据和方法封装在对象内部,对外隐藏细节(通过访问修饰符控制),提高安全性和复用性。

- 继承:子类继承父类的属性和方法,实现代码复用,支持 “多态” 的基础。

- 多态:同一行为在不同对象上有不同表现形式(如方法重写、接口实现),提高代码灵活性。

- 优点:代码复用性高、易维护、易扩展,适合复杂、大型项目。

- 缺点:结构复杂、执行效率略低于面向过程(额外的对象开销)。

- 典型代表:Java、Python、C++、C#。

3. 其他常见范式

- 函数式编程:以 “函数” 为核心,强调纯函数(无副作用)、不可变数据,通过函数组合实现逻辑,如 Haskell、Scala、JavaScript(ES6+)。

- 声明式编程:关注 “做什么” 而非 “怎么做”,如 SQL(只写查询逻辑,不关心执行步骤)、HTML/CSS。

面向对象是模拟现实世界的一种编程范式,通过封装、继承、多态实现高内聚低耦合。

2.简单聊聊封装、多态、继承

- 封装

- 把属性私有化,方法控制访问,保护对象的一致性。

- 继承

- 子类复用父类代码,避免重复。

- 多态

- 统一接口,不同实现,运行时决定调用谁。

- 实现机制

9.Integer和Int的区别?什么时候用Integer?new Integer(1)会不会从缓存中取?

-

int是基础类型,Integer是它的包装类,核心区别在于

- int有默认值,Integer可为null

- Integer在-128~127有缓存池

-

new Integer(1) 每次创建新对象,Integer.valueOf(1) 会命中缓存。

| 追问 | 回答要点(直接背,面试必秒杀) |

|---|---|

| Integer a = 1; Integer b = 1; 为什么 a == b 为 true? | 因为自动装箱时调用 Integer.valueOf(1),而 valueOf() 在 -128~127 范围内会直接返回 IntegerCache 缓存中的对象,所以 a 和 b 指向同一个对象,== 为 true |

| new Integer(1) == new Integer(1) 呢? | false。new 每次都在堆上创建新对象,即使数值相同,地址也不同 |

| new Integer(1) == 1 呢? | true。会触发自动拆箱,把 Integer 转成 int 再比较值 |

| Integer a = 1; Integer b = new Integer(1); a == b 呢? | false。一个走缓存,一个 new 新对象,地址不同 |

| Integer a = 128; Integer b = 128; a == b 呢? | false(JDK 默认情况下)。128 超出缓存范围,valueOf() 每次都 new 新对象 |

| 缓存范围能改吗? | 可以!JVM 参数:-XX:AutoBoxCacheMax=666(JDK 8+ 支持)或者 -Djava.lang.Integer.IntegerCache.high=1000 |

| 为什么默认缓存 -128 ~ 127? | 刚好覆盖 byte 的取值范围(-128 ~ 127),日常业务中小整数使用最频繁,缓存收益最大 |

| Integer 是线程安全的吗? | 线程安全。因为 Integer 是不可变类(private final int value + 所有方法不修改状态),多个线程读同一个对象完全没问题 |

| 那 Integer a = 1; a = a + 1; 会不会线程不安全? | 这段代码不安全!因为 a = a + 1 会触发拆箱 → 计算 → 重新装箱 → 赋值,属于复合操作,没有同步,多个线程并发执行可能出现值覆盖 |

10.List为什么只能用Integer 不能用int的原因是什么?

List 只能用 Integer,不能用 int,是因为 Java 泛型只接受引用类型,int 是基本类型,编译器不认识。

11.介绍下NIO,NIO中channel的作用?

| 代号 | 全称 | 线程模型 | 阻塞性 | 底层系统调用 | 典型场景 |

|---|---|---|---|---|---|

| BIO | Blocking I/O | 一连接一线程 | 阻塞 | accept()/read() |

连接数 < 1000 |

| NIO | Non-blocking I/O | 1 个线程管 N 个连接 | 非阻塞 | epoll |

10w+ 长连接 |

| AIO | Asynchronous I/O | 回调/ Future | 完全异步 | IOCP |

Windows 高吞吐 |

12.什么是乐观锁、悲观锁?区别是什么呢?原理呢?

乐观锁:在操作数据时不会立即加锁。它会在提交更新时,检查在此期间数据是否被其他线程修改过。

悲观锁:在进行任何数据操作之前,都会先获取锁,确保在整个数据处理过程中,没有人能够修改它。

- 乐观锁:CAS操作、版本号机制(如数据库乐观锁)、Atomic系列类、StampedLock乐观读。

- 悲观锁:synchronized、ReentrantLock、数据库行锁。

13、线程有几种实现方式?有什么状态?

// 1. 继承 Thread

Thread → new MyThread().start()

// 2. 实现 Runnable

public class Demo2 {

public static void main(String[] args) {

Thread t = new Thread(new MyRunnable());

t.start();

System.out.println("main 线程");

}

}

class MyRunnable implements Runnable {

@Override

public void run() {

System.out.println("方式2:实现 Runnable");

}

}

// 3. 带返回值 Callable

FutureTask<String> task = new FutureTask<>(() -> "OK");

new Thread(task).start();

System.out.println(task.get());

// 4. 线程池(推荐!)

Executors.newCachedThreadPool().execute(() -> System.out.println("Hi"));

//5.Lambda 简化

// Runnable

new Thread(() -> System.out.println("Lambda Runnable")).start();

// Callable

FutureTask<String> task = new FutureTask<>(

() -> "Lambda Callable 返回值"

);

new Thread(task).start();

System.out.println(task.get());

NEW

│ start()

▼

RUNNABLE ←────────────────────────┐

│ sleep(1000) join(1000) │

▼ ──────────────► TIMED_WAITING

│ wait() park() │

▼ ──────────► WAITING │

│ synchronized(锁) │

▼ ────────► BLOCKED ◄──────────┘

│ run() 结束

▼

TERMINATED

14、finalize方法

“finalize 是 Object 的方法,GC 前可能调用一次,用于资源清理。 但不确定、性能差、已废弃,实际开发一律不用! 用 try-with-resources 或 Cleaner 替代。”

finalize() 是 Object 类的一个 protected 方法,子类可以重写。当对象第一次被 GC 判定为可回收时,JVM 会调用它的 finalize() 方法(如果重写了的话),而且只调用一次。 在 finalize() 里可以通过 this 重新把自己赋值给某个强引用,从而“复活”自己(逃脱本次 GC)。但下一次再被回收时,就再也不调用 finalize() 了,直接死。 从 JDK9 开始已被标记为 deprecated,JDK14 正式建议彻底移除,理由是:性能差、不可靠、存在安全隐患、破坏了 GC 效率。

15、说说抽象类和接口的区别。

- 抽象类可含普通属性/方法/构造器

- 接口(JDK8 前)只能含 public abstract 方法和 public static final 常量;

- 普通方法

- Java 8 前:不能有实现

- Java 8+:支持 default 方法(有实现)

- Java 9+:支持 private 方法

- 普通方法

- 一个类只能继承一个抽象类,但可实现多个接口。

- 抽象类偏向“父子继承 + 代码共享”,接口偏向“行为契约 + 多实现”。

- 优先使用接口实现解耦,必要时用抽象类共享代码。

| 特性 | 抽象类 | 接口 |

|---|---|---|

| 继承 | extends(单继承) |

implements(多实现) |

| 方法实现 | 可有完整实现 | 默认无实现(Java 8+ 可 default) |

| 成员变量 | 可有实例变量 | 只能 public static final |

| 构造器 | 有 | 无 |

| 访问修饰符 | 灵活 | 方法默认 public |

| 设计意图 | is-a 关系,代码复用 | can-do 能力,行为规范 |

16、synchonized和lock的区别?synchonized优化

synchronized 是 JVM 内置锁,自动释放,基于 monitorenter/monitorexit;Lock 是显式锁(ReentrantLock),需手动 unlock,支持公平锁、条件等待、tryLock 和中断。

Synchronized

- 是JAVA实现线程同步最基础最主要的关键字,是一种内置的锁机制,属于悲观锁的范畴,主要保证同一时期,只有一个线程能执行特定代码块和方法

Lock

Lock接口定义了更广泛的锁定操作。它提供了一种获取锁、尝试获取锁、可中断地获取锁以及释放锁的方法,并且提供了比synchronized更多的控制维度。

17、为什么线程多的时候要使用锁而不是CAS?

线程多时 CAS 竞争激烈,自旋重试耗 CPU + 缓存失效风暴,导致吞吐量雪崩;锁通过线程挂起(Park)让出 CPU,结合锁升级优化,整体性能更稳定。

CAS 是乐观策略,线程少、无竞争时最快; 线程多、竞争激烈时 CAS 会疯狂自旋 + 缓存失效,性能反而崩得比锁还惨。 synchronized(JDK 8+)有偏向锁 → 轻量级锁 → 重量级锁三级自适应,竞争激烈时直接升级成重量级锁让大部分线程快速阻塞+挂起,不占用 CPU,整体吞吐完胜疯狂自旋的 CAS。

真实数据(64 核机器,100 万次计数器累加):

| 方案 | 耗时(越小越好) | 说明 |

|---|---|---|

| AtomicLong 纯 CAS | ~2800 ms | 高竞争疯狂自旋,CPU 100%,缓存乒乓 |

| LongAdder | ~180 ms | 内部自动切换 CounterCell 分片 |

| synchronized | ~220 ms | 直接升级重量级锁,线程挂起不占 CPU |

结论:线程多、竞争激烈时,锁 > 纯 CAS。

- 那为什么 ConcurrentHashMap 桶不直接用重量级锁?

- → 因为绝大部分桶根本没人竞争,用 synchronized 首节点 + 偏向锁几乎零开销

- AtomicInteger 比 synchronized 慢在哪?

- → 高竞争时自旋 + 缓存失效

- 那我能不能永远用 LongAdder 替代 synchronized?

- → 不行,LongAdder 只适合纯计数,不能保护复杂逻辑

- CAS(Compare-And-Swap)是一条 CPU 原子指令,完整执行流程分 3 步:

- 读内存当前值(A)

- 比较 A 是否等于预期值(old)

- 相等才把内存写成新值(new),不相等什么都不干 整个 1→2→3 由 CPU 在硬件层面一次性完成,绝不被打断,所以线程安全。

- volatile 是 Java 提供的轻量级同步机制,保证两个语义:

- 可见性:一个线程修改了 volatile 变量,另一个线程立刻能看到最新值

- 禁止指令重排序(有序性) 但不保证原子性(i++ 仍然线程不安全)。 底层靠内存屏障(Lock 前缀指令)实现:写 volatile → StoreLoad 屏障刷新缓存,读 volatile → LoadLoad 屏障阻止前面的指令重排。

18、谈一下异常,erorr和exception的区别,讲一下受检异常和非受检异常,说一下RuntimeException都有哪些,非受检异常有哪些?如何处理异常

-

Error 是 JVM 级严重错误(如 OOM、StackOverflow),不可恢复不应捕获;Exception 是程序级异常,可处理,其中 RuntimeException 为非受检异常,其余为受检异常。

-

受检异常(Checked)继承自 Exception 但非 RuntimeException,编译强制处理;非受检(Unchecked)是 RuntimeException 及其子类,运行时抛出,编译不强制。

-

常见 RuntimeException:NullPointerException、ArrayIndexOutOfBoundsException、ClassCastException、IllegalArgumentException、UnsupportedOperationException 等;所有 RuntimeException 及其子类 + Error 均为非受检异常。

-

异常类 继承关系 是否 Unchecked 典型触发场景 生产防御最佳实践(直接背) NullPointerException ← RuntimeException Unchecked 对象为 null 时调用方法/访问字段 1. Objects.requireNonNull(obj, "xxx不能为空")

2.Optional.ofNullable(x).orElse(default)

3. Lombok @NonNullIndexOutOfBoundsException ← RuntimeException Unchecked list.get(i)、array[i]、substring参数越界if (i >= 0 && i < list.size())

Guava:checkPositionIndexes(start, end, size)ClassCastException ← RuntimeException Unchecked 强制类型转换失败(如 (Dog) animal但 animal 是 Cat)if (animal instanceof Dog)

或使用泛型彻底避免IllegalArgumentException ← RuntimeException Unchecked 参数非法(自己校验失败时抛) 入参统一校验(@Valid + Bean Validation)

手动:Preconditions.checkArgument(age > 0, "年龄必须大于0")IllegalStateException ← RuntimeException Unchecked 对象当前状态不允许执行操作(如已关闭的连接再 close) 状态机防护: if (state != RUNNING) throw new IllegalStateException("当前状态不支持此操作")UnsupportedOperationException ← RuntimeException Unchecked 调用了接口未实现的方法(如 unmodifiableList.add())防御性返回不可变集合: Collections.unmodifiableList(list)List.of(...)(JDK9+)ConcurrentModificationException ← RuntimeException Unchecked foreach 遍历时集合被结构性修改(add/remove) 1. 改用迭代器 Iterator.remove()

2. 读写分离:CopyOnWriteArrayList(写少读多)

3. 加锁遍历ArithmeticException ← RuntimeException Unchecked 除以 0、取模 0、 BigDecimal除不尽且没设置 RoundingModeif (divisor == 0) throw new IllegalArgumentException("除数不能为0")

BigDecimal 用divide(divisor, RoundingMode.HALF_UP)NumberFormatException ← IllegalArgumentException Unchecked Integer.parseInt("abc")try { Integer.parseInt(str) } catch (NumberFormatException e) { ... }

GuavaInts.tryParse(str)NoSuchElementException ← RuntimeException Unchecked Optional.get()没值、queue.remove()空队列改用 Optional.orElse(...)、queue.poll()、GuavaIterators.getNext(iterator, default)

-

-

受检异常

-

异常类 包路径 继承关系 是否 Checked(必须捕获/抛出) 常见触发场景 & 面试重点 IOException java.io← Exception Checked 所有 I/O 操作的父异常(文件、网络、管道等) FileNotFoundException java.io← IOException Checked 文件不存在或路径错误, new FileInputStream("xxx")时常见EOFException java.io← IOException Checked 读到文件末尾但还想继续读(如 DataInputStream.readFully) SQLException java.sql← Exception Checked 所有数据库操作异常(连接、SQL 语法、约束违反等) ClassNotFoundException java.lang← ReflectiveOperationException Checked Class.forName("com.xxx.X")找不到类,动态加载失败NoSuchMethodException java.lang← ReflectiveOperationException Checked 反射调用 getMethod()、getConstructor()找不到方法InvocationTargetException java.lang.reflect← ReflectiveOperationException Checked 反射调用目标方法时抛出的原始异常会被包装成这个(getCause() 取真实异常) InterruptedException java.lang← Exception Checked Thread.sleep()、wait()、BlockingQueue.take()等阻塞操作被interrupt()打断ParseException java.text← Exception Checked SimpleDateFormat.parse()、DecimalFormat.parse()格式不匹配MalformedURLException java.net← IOException Checked new URL("http://")地址格式非法

-

19、什么是阻塞和非阻塞,什么是同步,异步?

阻塞/非阻塞 关注线程等待状态:阻塞 → 调用后线程挂起;非阻塞 → 立即返回,需轮询。

同步/异步 关注结果获取方式:同步 → 调用者主动等结果;异步 → 回调/未来通知结果。

| 维度 | 阻塞(Blocking) | 非阻塞(Non-blocking) |

|---|---|---|

| 系统调用 | read() 直到数据到位才返回 | read() 立即返回 EAGAIN |

| 线程状态 | WAITING / BLOCKED(Park) | RUNNABLE(轮询或事件驱动) |

| 典型 API | InputStream.read() | SocketChannel.read() + O_NONBLOCK |

| 维度 | 同步(Synchronous) | 异步(Asynchronous) |

|---|---|---|

| 结果获取 | 调用者主动等待 | 系统回调通知 |

| 典型实现 | Future.get() 阻塞等 | CompletableFuture + Callback |

| 内核支持 | 无需 | 需要 io_uring / AIO |

20、什么是反射?反射的用途?为什么java需要反射,c++不需要。

Java 反射机制是在运行期动态加载类、获取类的一切信息(方法、字段、构造器、注解等),并能操作它们,核心是 JVM 在运行时为每一个加载的类都生成了一个 java.lang.Class 对象,保存了类的完整结构信息。

Java 是 解释 + 动态加载,类在运行时才确定,反射是框架动态操作的基石;C++ 是 静态编译,模板在编译期展开,依赖注入/序列化靠模板元编程,无需运行时反射。

| 方式 | 代码 | 说明 | 适用场景 |

|---|---|---|---|

| 1. Class.forName + newInstance()(最经典) | User user = (User) Class.forName("com.User").newInstance(); |

需要无参构造器,JDK9 已废弃 newInstance() | 老项目、框架(如 Spring 早期) |

| 2. Class 对象 + getConstructor().newInstance()(推荐) | Constructor<User> c = User.class.getConstructor(); User user = c.newInstance(); |

可指定任意构造器,传参,支持私有构造 | Spring、MyBatis 等现代框架主流方式 |

| 3. 直接 Constructor.newInstance()(最常用) | User user = User.class.getConstructor(String.class, int.class) .newInstance("张三", 18); |

功能最全,支持私有构造 + 带参 | 所有需要反射创建对象的场景 |

如果我们动态获取到这些信息,我们需要依靠 Class 对象。Class 类对象将一个类的方法、变量等信息告诉运行的程序。

Java 提供了四种方式获取 Class 对象:

1. 知道具体类的情况下可以使用:

Class alunbarClass = TargetObject.class;

但是我们一般是不知道具体类的,基本都是通过遍历包下面的类来获取 Class 对象,通过此方式获取 Class 对象不会进行初始化

2. 通过 Class.forName()传入类的全路径获取:

Class alunbarClass1 = Class.forName("cn.javaguide.TargetObject");

3. 通过对象实例instance.getClass()获取:

TargetObject o = new TargetObject();

Class alunbarClass2 = o.getClass();

4. 通过类加载器xxxClassLoader.loadClass()传入类路径获取:

ClassLoader.getSystemClassLoader().loadClass("cn.javaguide.TargetObject");

通过类加载器获取 Class 对象不会进行初始化,意味着不进行包括初始化等一系列步骤,静态代码块和静态对象不会得到执行

| 序号 | 获取方式 | 代码示例 | 说明&特点 |

|---|---|---|---|

| 1 | 类名.class(最常用、最推荐) | Class<User> clazz = User.class; |

编译期就确定,类型安全,不会抛异常 |

| 2 | 对象.getClass()(运行时才有对象时用) | User user = new User(); Class<? extends User> clazz = user.getClass(); |

继承自 Object,返回运行时真实类型 |

| 3 | Class.forName(“全限定类名”)(动态加载) | Class<?> clazz = Class.forName("com.example.User"); |

常用于配置文件、插件系统,会触发静态块初始化,可能抛 ClassNotFoundException |

| 4 | 类加载器加载(高级用法) | Class<?> clazz = ClassLoader.getSystemClassLoader().loadClass("com.example.User"); |

不会触发类初始化(静态块不执行),常用于热加载、自定义类加载器 |

| 问题 | 答案 |

|---|---|

Class.forName() 和 ClassLoader.loadClass() 的区别? |

forName() 会执行静态代码块(类初始化) loadClass() 只加载类,不初始化 |

| 哪种方式最安全? | User.class(编译期确定) |

| Spring/MyBatis 里常用哪种? | Class.forName()(读取配置动态加载驱动、Mapper 等) |

| 基本数据类型也能获取 Class 吗? | 可以!int.class、Integer.TYPE |

| 题目 | 答案数量 | 具体方式 |

|---|---|---|

| 获取 Class 对象的方式 | 4 种 | .class、.getClass()、Class.forName()、ClassLoader.loadClass() |

| 反射创建对象实例的方式 | 3 种 | Class.forName().newInstance()、class.getConstructor().newInstance()、Constructor.newInstance() |

21、有哪些方式可以创建一个对象?

反序列化(ObjectInputStream.readObject()) 附加:new 变种(数组、String 常量池)、工厂/Builder、动态代理、虚拟线程(JDK21)。

| 方式 | 关键字/机制 | 是否调用构造器 | 说明 |

|---|---|---|---|

1. new 关键字 |

new |

是 | 最常见 |

2. Class.forName().newInstance() |

反射 | 是 | 动态加载 |

3. Constructor.newInstance() |

反射 | 是 | 更灵活 |

4. clone() |

复制 | 否 | 浅拷贝 |

| 5. 反序列化 | ObjectInputStream |

否 | 从字节流恢复 |

6. newInstance()(已废弃) |

Constructor |

是 | Java 9 后不推荐 |

| 7. 工厂方法 / 建造者模式 | 自定义 | 是 | 封装创建逻辑 |

8. Unsafe.allocateInstance() |

底层 | 否 | 不调用构造器(危险) |

- 工厂方法 / 建造者模式(设计模式)

// 工厂方法

public static Person create(String name, int age) {

return new Person(name, age);

}

// 建造者模式

Person p = Person.builder()

.name("Tom")

.age(25)

.build();

封装创建逻辑,更灵活、可读性强

- Unsafe.allocateInstance()(底层,不推荐)

import sun.misc.Unsafe;

import java.lang.reflect.Field;

Field f = Unsafe.class.getDeclaredField("theUnsafe");

f.setAccessible(true);

Unsafe unsafe = (Unsafe) f.get(null);

Person p = (Person) unsafe.allocateInstance(Person.class); // 不调用构造器!

p.name = "Tom"; // 直接操作字段

不调用构造器,绕过初始化,仅用于框架/序列化库

22、多线程和协程的优缺点

多线程:内核级,抢占式调度,适合 CPU 密集型,真并行,但上下文切换贵(1-10μs)、内存大(1MB 栈)。

协程:用户态,轻量协作式,适合 I/O 密集型,单线程高并发(10w+),切换快(<1μs)、栈小(几KB),但不能利用多核。

| 排名 | 场景 | 传统多线程写法 | 2024~2025 推荐写法(协程/虚拟线程) | 真实占比 |

|---|---|---|---|---|

| 1 | 异步发日志 / 埋点 / 审计 | @Async + TaskExecutor | 虚拟线程(几乎零改造) | 90% |

| 2 | 异步发送邮件 / 短信 / 站内信 | @Async | 虚拟线程 | 85% |

| 3 | 定时任务(Corn / 动态定时) | @Scheduled(fixedRate) | 虚拟线程 + ScheduledExecutor | 80% |

| 4 | 批量导入 / 导出(Excel、CSV) | 多线程分片 + CountDownLatch | 虚拟线程 StructuredTaskScope(JDK21) | 75% |

| 5 | 高并发对外 HTTP 接口(10w+) | Tomcat + 线程池 | Netty + WebFlux 或 虚拟线程 | 60% |

| 6 | 消息队列消费(RocketMQ/Kafka) | @RocketMQMessageListener | 虚拟线程消费(2024 年新趋势) | 50% |

| 7 | 限流熔断降级(Sentinel) | 内部就是线程池 | 虚拟线程 + Resilience4j | 40% |

| 8 | 网关层(Spring Cloud Gateway) | Netty + Reactor | 已经默认协程(Reactor),未来可换虚拟线程 | 100% |

23、基础类和继承类

| 题目 | 答案 |

|---|---|

| 8种基本类型 | byte(1), short(2), int(4), long(8), float(4), double(8), char(2), boolean(1) |

| String 可继承? | 不可,8 个包装类全都不可以被继承!全部都是 final 类! |

| String 拼接用哪个? | 单线程:StringBuilder,多线程:StringBuffer |

| List 读多用哪个? | ArrayList |

| List 头尾操作用哪个? | LinkedList |

| 特性 | String |

StringBuffer |

StringBuilder |

|---|---|---|---|

| 可变性 | 不可变 | 可变 | 可变 |

| 线程安全 | 是(不可变) | 是(synchronized) | 否 |

| 性能 | 拼接慢(创建新对象) | 中等 | 最快 |

| 适用场景 | 常量、少量拼接 | 多线程拼接 | 单线程高频拼接 |

24、ArrayList VS LinkedList

| 维度 | ArrayList |

LinkedList |

|---|---|---|

| 底层结构 | 动态数组 | 双向链表 |

| 随机访问 | O(1) | O(n) |

| 插入/删除 | O(n)(中间移位) | O(1)(头尾) |

| 内存开销 | 小(数组) | 大(每个节点两个指针) |

| 适用场景 | 读多写少、随机访问 | 头尾操作频繁、插入删除多 |

25、讲讲类的实例化顺序

父类 → 子类,静态 变量→ 成员变量 → 构造方法 完整执行顺序(死记版):

父静 → 子静 → 父普 → 父构 → 子普 → 子构

- 父类静态变量 / 父类静态代码块(按书写顺序)

- 子类静态变量 / 子类静态代码块(按书写顺序)

- 父类普通成员变量赋值 → 父类普通代码块

- 父类构造方法

- 子类普通成员变量赋值 → 子类普通代码块

- 子类构造方法

26、JAVA有顺序的map

Java 中真正“有顺序”的 Map 只有 LinkedHashMap(插入顺序)和 TreeMap(键排序), 前者靠双向链表,后者靠红黑树,选型看你是要“插入顺序”还是“键排序”。

| 实现类 | 有序类型 | 保证顺序的底层机制 | 适用场景 |

|---|---|---|---|

| LinkedHashMap | 插入顺序 | 继承 HashMap + 维护一个双向链表(before/after 指针) | 最常用,缓存、LRU |

| TreeMap | 键的自然顺序(或 Comparator) | 红黑树(自平衡二叉搜索树) | 需要按 key 排序(范围查询) |

| ConcurrentSkipListMap | 键的自然顺序(线程安全) | 跳表(Skip List) + 并发设计 | 高并发有序 Map |

| Map 实现类 | 数据结构 | 插入顺序? | 排序顺序? | 线程安全? | 时间复杂度(get/put) |

|---|---|---|---|---|---|

| HashMap | 数组 + 链表/红黑树 | × | × | × | O(1) |

| LinkedHashMap | HashMap + 双向链表 | √ | × | × | O(1) |

| TreeMap | 红黑树 | × | √ | × | O(log n) |

| ConcurrentHashMap | 分段数组 + 链表/红黑树 | × | × | √ | O(1) |

| ConcurrentSkipListMap | 跳表(多层链表) | × | √ | √ | O(log n) |

- 分布式缓存客户端:如 Redis 客户端的本地缓存,用

ConcurrentHashMap存储热点数据,避免频繁访问 Redis。 - 接口限流计数器:统计每个接口的请求次数,多线程并发更新计数,

ConcurrentHashMap<String, AtomicInteger>是典型用法。 - 线程池任务存储:自定义线程池中存储任务的状态(如待执行、执行中、已完成),用

ConcurrentHashMap维护任务 ID 与任务对象的映射。

27、继承和聚合

- 继承 is-a 强,聚合 has-a 松

- 继承是“生死与共”的亲父子关系,聚合是“可换可离”的合作关系

- 能用聚合(组合)解决的,坚决不用继承!

| 面试官问题 | 标准回答(直接背) |

|---|---|

| 为什么说“优先使用组合而非继承”? | 继承破坏封装性、增加耦合、父类改动会影响所有子类;组合更灵活、符合开闭原则 |

| 继承有什么风险? | 白箱复用、父类变化影响子类、容易造成类爆炸(继承层级太深) |

| 聚合和组合的区别?(进阶) | 聚合(弱):部分可以脱离整体存在 组合(强):部分和整体生命周期一致 |

| 什么时候必须用继承? | 1. 明确 is-a 关系 2. 需要多态(父类引用指向子类对象) 3. 需要复用父类代码且无法用组合实现 |

28、描述动态代理的几种实现方式,分别说出相应的优缺点

日常开发/Spring 项目:有接口用 JDK,无接口用 CGLIB 就够了

| 实现方式 | 所属技术 | 能否代理类(无接口) | 性能排序 | 线程安全 | 优点 | 缺点 |

|---|---|---|---|---|---|---|

| 1. JDK 动态代理 | java.lang.reflect | ❌ 只能代理接口 | ★★★☆☆ | 是 | 1. JDK 原生,无额外依赖 2. 实现简单,稳定 3. 所有框架都支持 | 1. 必须实现接口 2. 反射调用,性能稍慢 3. 不能代理 final 类 |

| 2. CGLIB | ASM 字节码框架 | √ 可以代理普通类 | ★★★★☆ | 是 | 1. 不需要接口,直接生成子类 2. 性能比 JDK 代理高 3. Spring 默认选择 | 1. 不能代理 final 类和 final 方法 2. 依赖第三方 jar 3. 老版本有内存泄漏风险(已修复) |

| 3. ByteBuddy | ByteBuddy | √ 可以代理类/接口 | ★★★★★ | 是 | 1. 性能最高(接近直接调用) 2. API 优雅,功能强大 3. 支持 Java 17+ 模块化 4. Netflix、Dubbo 3 等大厂使用 | 1. 学习成本稍高 2. 依赖第三方 jar |

| 4. Javassist | Javassist | √ 可以代理类/接口 | ★★★★☆ | 是 | 1. API 简单,容易上手 2. 生成字节码可读性好 3. Hibernate、Quartz 使用 | 1. 性能略低于 ByteBuddy 2. 依赖第三方 jar |

| 5. ASM(底层黑魔法) | ASM | √ | ★★★★★ | 是 | 1. 性能最强(直接操作字节码) 2. 体积最小 3. CGLIB、ByteBuddy 底层都用它 | 1. 学习曲线极陡 2. 手写字节码极易出错 3. 基本没人手写 |

JDK动态代理和CGLIB的区别

JDK 动态代理靠接口 + 反射,CGLIB 靠继承子类 + invokeSuper

Spring 默认策略:有接口用 JDK,无接口或强制 proxy-target-class=true 就用 CGLIB

99% 的场景用 Spring 自动选择就行,只有极致性能才自己选

JDK 动态代理和 CGLIB 是 Spring AOP 默认使用的两种代理方式,主要区别有以下 5 点:

- 实现原理不同

- JDK 动态代理基于接口,底层通过 java.lang.reflect.Proxy 类,利用反射生成一个实现目标接口的代理类。

- CGLIB 基于继承,底层是 ASM 字节码框架,直接生成目标类的子类。

- 使用条件不同

- JDK 代理要求目标类必须实现接口。

- CGLIB 不要求实现接口,只要类不是 final、方法不是 final/private 就能代理。

- 性能区别

- JDK 代理创建对象更快(因为用反射),但调用方法稍慢。

- CGLIB 创建对象稍慢(因为要生成字节码),但调用方法更快(用了 FastClass 索引机制)。 Spring 5.3+ 默认已经用 JDK 代理性能更好。

- Spring 的默认选择策略

- Spring 5.0 以前:有接口用 JDK,没有接口用 CGLIB。

- Spring 5.0 之后(包括 Spring Boot 2+):优先使用 JDK 动态代理,只有当类没有实现任何接口时才用 CGLIB。 (源码:DefaultAopProxyFactory 判断逻辑)

- 不能被代理的情况

- final 类、final 方法、private 方法都不能被 CGLIB 代理

- 没接口且类是 final 的,AOP 就彻底失效

| 对比维度 | JDK 动态代理(java.lang.reflect.Proxy) | CGLIB(Code Generation Library) |

|---|---|---|

| 底层实现原理 | 运行时动态生成实现接口的代理类(字节码) | 运行时动态生成目标类的子类(继承) |

| 是否必须实现接口 | 必须(只能代理接口) | 不需要(可以直接代理普通类) |

| 代理方式 | 实现接口 + InvocationHandler | 生成子类 + MethodInterceptor |

| 能否代理 final 类 | ❌ 不能(final 类不能被继承) | ❌ 不能(final 类不能被继承) |

| 能否代理 final 方法 | ❌ 不能(final 方法不能被重写) | ❌ 不能 |

| 能否代理私有方法 | ❌ 不能(只能代理接口方法) | ❌ 不能(私有方法无法重写) |

| 能否代理静态方法 | ❌ 不能 | ❌ 不能 |

| 性能 | 较慢(反射 + invoke 调用) | 更快(子类直接调用 super) |

| 生成的代理类位置 | 内存中($Proxy0、$Proxy1…) | 默认保存到磁盘(可配置关闭) |

| 依赖 | JDK 原生,无额外 jar | 需要引入 cglib jar(或 spring-boot-starter-aop 已包含) |

| Spring AOP 默认选择 | 有接口时用 JDK | 无接口或强制 proxy-target-class=true 时用 CGLIB |

| 典型使用场景 | MyBatis Mapper、Spring AOP(有接口) | Spring AOP(无接口)、Hibernate 懒加载、方法耗时统计 |

29、为什么 CGLIB 不能代理“纯接口”?

CGLIB 是通过“继承实现类”来完成代理的,所以它天然不能代理“纯接口”,只能代理具体的 class。 反过来,JDK 动态代理正好相反:只能代理接口,不能代理普通类。

| 技术 | 能代理“纯接口”(没有实现类的 interface)吗? | 能代理“普通类”(没有实现任何接口的 class)吗? |

|---|---|---|

| JDK 动态代理 | √ 可以 | × 不行 |

| CGLIB | × 不行 | √ 可以 |

30、Final的用途

| 使用位置 | 写法示例 | 核心作用(一句话) | 实际意义 & 典型场景 |

|---|---|---|---|

| 1. 修饰变量 | final int MAX = 100; final String NAME; |

不可重新赋值 | 常量、配置值、线程安全、让 JVM 优化(内联常量) |

| 2. 修饰方法 | public final void save() {} |

子类不能重写 | 防止子类误改核心逻辑(如模板方法中的关键步骤) |

| 3. 修饰类 | public final class String {} |

不能被继承 | 保证设计不变、线程安全、性能优化(如字符串常量池) |

| 位置 | 具体效果 | 经典使用场景(大厂都这么写) |

|---|---|---|

| final 变量 | 基本类型:值不可变 引用类型:引用地址不可变(对象内容仍可变) | private final UserRepository userRepository;(Spring 依赖注入) public static final long SERIAL_VERSION_UID = 1L; |

| final 方法 | 不能被 override,但可以被重载 | Object.getClass()、Thread.isInterrupted() 防止子类破坏逻辑 |

| final 类 | 不能有子类,典型代表:String、Integer、Long、Double 等包装类 |

不可变类设计,保证线程安全 + 允许 JVM 做常量池优化 |

| 问题 | 标准答案(金句) |

|---|---|

| final 变量真的完全不可变吗? | 基本类型完全不可变,引用类型只能保证“引用不变”,对象内容仍可变(所以要配合不可变对象设计) |

| final 和 immutable 的区别? | final 是语言层面的“不可再赋值”,immutable 是设计层面的“所有状态都不可变”(如 String) |

| final 方法可以被重载吗? | 可以重载,但不能被重写 |

| final 有什么性能好处? | JVM 可以内联 final 方法和常量,提升运行速度(尤其是 static final) |

| Spring 中为什么这么爱用 final? | 让 bean 的依赖在构造器注入后不可变,更符合函数式编程和线程安全理念 |

31、给出三种单例模式

1. 饿汉式(最简单,最常用,99% 公司都在用)

public class Singleton1 {

// 类加载时就创建,天然线程安全

private static final Singleton1 INSTANCE = new Singleton1();

private Singleton1() {

// 防止反射破坏

// throw new RuntimeException("单例禁止反射调用");

}

public static Singleton1 getInstance() {

return INSTANCE;

}

}

// 优点:简洁、无锁、绝对线程安全

// 缺点:即使你不用它,也会提前加载(几乎没影响)

2. 静态内部类(完美平衡,面试最爱写)

public class Singleton2 {

private Singleton2() {}

// 只有第一次调用 getInstance 时才会加载内部类,天才设计!

private static class Holder {

private static final Singleton2 INSTANCE = new Singleton2();

}

public static Singleton2 getInstance() {

return Holder.INSTANCE;

}

}

// 优点:延迟加载 + 线程安全 + 性能高 + 防反射 + 防序列化破坏

// 缺点:没有(真的没有)

public class Singleton {

// 1. 私有构造,防止外部 new

private Singleton() {

// 可选:防反射破坏

if (Holder.INSTANCE != null) {

throw new RuntimeException("单例已被破坏!");

}

}

// 2. 静态内部类持有唯一实例

private static class Holder {

private static final Singleton INSTANCE = new Singleton();

}

// 3. 对外提供获取方法

public static Singleton getInstance() {

return Holder.INSTANCE;

}

// 业务方法

public void doSomething() {

System.out.println("我是单例:" + this.hashCode());

}

}

3. 枚举单例(Effective Java 作者推荐,最强防破解版)

public enum Singleton3 {

INSTANCE; // 唯一实例

// 可以直接加业务方法

public […]void doSomething() {

System.out.println("我是世界上最强的单例");

}

}

// 使用

Singleton3.INSTANCE.doSomething();

优点:

- 天生线程安全

- 防止反射攻击(反射会抛异常)

- 防止序列化破坏(JVM 保证)

- 防止反序列化创建新对象

- 代码最少

| 实现方式 | 懒加载 | 线程安全 | 性能 | 防反射 | 防序列化 | 代码量 | 推荐场景 |

|---|---|---|---|---|---|---|---|

| 饿汉式 | No | Yes | 高 | No | No | 少 | 99% 项目(最常用) |

| 静态内部类 | Yes | Yes | 高 | Yes | Yes | 中 | 追求完美(推荐) |

| 枚举 | No | Yes | 高 | Yes | Yes | 最少 | 怕被破解/配置类 |

补充:双重检查锁(DCL)

// 虽然能用,但容易写错,面试写出来会被扣分

public class Singleton {

private static volatile Singleton instance; // 必须加 volatile!

private Singleton() {}

public static Singleton getInstance() {

if (instance == null) {

synchronized (Singleton.class) {

if (instance == null) {

instance = new Singleton();

}

}

}

return instance;

}

}

终极结论(面试直接说):

| 场景 | 推荐写法 |

|---|---|

| 普通项目 | 饿汉式(最简单) |

| 追求极致/怕被问细节 | 静态内部类 |

| 配置类/工具类/怕被破解 | 枚举(最强) |

为什么必须加 volatile?(99% 的人都说不清)

这行代码:

java

instance = new Singleton();

实际上在 JVM 里会被拆成 3 步:

- 分配内存空间

- 在内存里执行构造方法,初始化对象

- 把 instance 引用指向这块内存(此时 instance ≠ null)

没有 volatile 时,2 和 3 可能被重排序!

可能执行顺序变成:1 → 3 → 2 导致其他线程在第 1 重检查时,看到 instance != null,但对象还没构造完 → 拿到一个“半成品对象” → 程序直接崩!

加了 volatile 后,JVM 插入内存屏障,禁止 2 和 3 重排序,完美解决。

“为什么第二重检查还要判断 null?”

→ 因为可能多个线程同时通过了第一重检查,进入锁块,必须再判断一次。

“volatile 可以去掉吗?”

→ JDK 1.4 及以前可以(那时候有 bug),JDK 5+ 必须加!

“怎么防止反射破坏?”

→ 构造器里判断 instance != null 就抛异常。

“怎么防止序列化破坏?”

→ 加 readResolve() 方法返回 instance。

“那你为什么不推荐 DCL?”

→ 因为容易写错(忘 volatile 就是事故),静态内部类写法更简单、更安全、性能一样高。

为什么不直接用 synchronized 方法? → 性能差 5~10 倍

为什么不直接用静态内部类? → 它才是最优解,DCL 基本被淘汰

那为什么还有人用 DCL? → 历史遗留 + 面试装逼专用

volatile 能不能去掉? → 不能!去掉会半初始化问题

32、能不能只在父类写一次 hashCode() 和 equals()

方案一、使用objects.hash() + instanceof基类

public abstract class BaseEntity {

private Long id; // 通常业务对象都靠 id 判断相等

// 所有子类自动继承这个完美的 equals 和 hashCode

@Override

public boolean equals(Object o) {

if (this == o) return true;

if (o == null || getClass() != o.getClass()) return false; // 严格类型比较

BaseEntity that = (BaseEntity) o;

return Objects.equals(id, that.id);

}

@Override

public int hashCode() {

return Objects.hash(getClass(), id); // getClass() 保证不同子类 hash 不冲突

}

// getter/setter...

}

public class User extends BaseEntity { ... }

public class Order extends BaseEntity { ... }

// 自动满足:new User(1L).equals(new User(1L)) → true

// new User(1L).equals(new Order(1L)) → false ### 方案二、Lombok

@Getter

@EqualsAndHashCode // ← 就这一行,全部搞定!

public abstract class BaseEntity {

private Long id;

}

@Entity

class User extends BaseEntity {

private String name;

private String email;

// 什么都不用写!自动按 id 生成 equals/hashCode

}

@EqualsAndHashCode(callSuper = true) // 让子类字段也参与

public class User extends BaseEntity {

private String name;

// equals 会同时比较 id + name

}

方案三、Apache Commons Lang

@Override

public boolean equals(Object o) {

return EqualsBuilder.reflectionEquals(this, o);

}

@Override

public int hashCode() {

return HashCodeBuilder.reflectionHashCode(this);

}

或者“只比较某些字段”:

@Override

public boolean equals(Object o) {

return new EqualsBuilder()

.appendSuper(super.equals(o))

.append(id, ((User)o).id)

.append(name, ((User)o).name)

.isEquals();

}

33、设计模式

Java 23 种经典设计模式(GoF)+ 常考现代模式(2025 面试终极版)

| 分类 | 设计模式 | 一句话作用 | 大厂真实使用场景(必背) |

|---|---|---|---|

| 创建型 | 1. 单例(Singleton) | 全局唯一实例 | Spring Bean(默认单例)、配置中心、线程池、日志对象 |

| 2. 工厂方法(Factory Method) | 接口定义工厂,子类决定实例化哪一个类 | MyBatis SqlSessionFactory、LoggerFactory | |

| 3. 抽象工厂(Abstract Factory) | 提供一个接口创建一系列相关对象 | Spring 的 BeanFactory(不同 profile 环境) | |

| 4. 建造者(Builder) | 复杂对象分步骤创建 | StringBuilder、Lombok @Builder、MyBatis Plus Wrapper | |

| 5. 原型(Prototype) | 通过 clone 创建对象 | 深拷贝场景、Spring prototype Bean | |

| 结构型 | 6. 适配器(Adapter) | 把不兼容的接口转换成目标接口 | Slf4j → Logback 适配、SpringMVC HandlerAdapter |

| 7. 装饰器(Decorator) | 动态给对象添加职责 | IO 流(BufferedInputStream)、Spring Cache | |

| 8. 代理(Proxy) | 控制对对象的访问 | Spring AOP、MyBatis Mapper 代理、Dubbo 远程调用 | |

| 9. 外观(Facade) | 为子系统提供统一入口 | SpringBoot 启动类、MyBatis Configuration | |

| 10. 组合(Composite) | 树形结构统一处理单个对象和组合对象 | 组织架构、文件目录、Vue 组件树 | |

| 11. 享元(Flyweight) | 大量细粒度对象共享 | Integer.valueOf(-128~127) 缓存、线程池里的 Thread | |

| 12. 桥接(Bridge) | 将抽象和实现分离 | JDBC Driver(DriverManager + 具体数据库驱动) | |

| 行为型 | 13. 模板方法(Template Method) | 定义算法骨架,子类实现具体步骤 | Spring JdbcTemplate、HttpServlet.service() |

| 14. 策略(Strategy) | 封装算法族,运行时可替换 | 支付方式切换、排序算法、Spring InstantiationStrategy | |

| 15. 观察者(Observer) | 一对多依赖,状态变化通知 | Spring Event、Guava EventBus、监听器模式 | |

| 16. 责任链(Chain of Responsibility) | 请求沿着链传递,直到被处理 | Filter 链、Spring Security 过滤器链、ExceptionHandler | |

| 17. 命令(Command) | 将请求封装为对象 | Runnable、MyBatis Plus 批量操作、事务回滚命令 | |

| 18. 迭代器(Iterator) | 遍历集合而不暴露内部结构 | List.iterator()、ResultSet | |

| 19. 中介者(Mediator) | 对象通过中介者通信,降低耦合 | Netty ChannelHandlerContext | |

| 20. 备忘录(Memento) | 保存和恢复对象状态 | 游戏存档、Spring BeanDefinition 快照 | |

| 21. 状态(State) | 对象行为随状态改变而改变 | TCP 连接状态机、订单状态流转 | |

| 22. 访问者(Visitor) | 在不改类的情况下添加新操作 | AST 解析器、MyBatis Plus 注解处理器 | |

| 23. 解释器(Interpreter) | 定义语法规则并解释 | Spring Expression Language (SpEL)、规则引擎 |

现代/常见扩展模式(大厂高频)

| 模式 | 说明 | 典型应用 |

|---|---|---|

| 工厂 Bean | Spring 中最常见的创建型模式 | @Bean、FactoryBean |

| 门面模式 | SpringBoot 自动配置类就是 Facade | spring-boot-starter-xxx |

| 代理模式 | Spring AOP、MyBatis Mapper 的核心 | CGLIB / JDK 动态代理 |

| 模板方法 | Spring 所有 XxxTemplate | RedisTemplate、RestTemplate |

| 策略 + 工厂 | 超级常见组合 | 支付路由、降级策略 |

面试经典回答模板(背完直接上)

我在项目中用过以下几种设计模式(挑 5~6 个说就够):

- 单例:Spring Bean 默认单例、全局配置类、工具类

- 工厂:MyBatis 的 SqlSessionFactory、Spring 的 BeanFactory

- 代理:Spring AOP 实现事务、日志、缓存;MyBatis Mapper 接口

- 模板方法:自定义 BaseService 封装公共 CRUD、继承 JdbcTemplate

- 策略模式 + 工厂:支付模块根据支付类型选择不同策略(支付宝、微信)

- 观察者:自定义事件发布/订阅、Spring ApplicationEvent

- 建造者:Lombok @Builder、MyBatis Plus QueryWrapper 链式构建

一句话总结(面试金句)

23 种经典模式中,真正天天用到的不超过 8 个:

单例、工厂、代理、模板方法、策略、观察者、建造者、装饰器

只要这 8 个能说出真实项目场景,99% 的面试都过!

34、深拷贝VS浅拷贝

| 对比维度 | 浅拷贝(Shallow Copy) | 深拷贝(Deep Copy) |

|---|---|---|

| 复制了什么 | 只复制对象本身 + 引用(地址) | 复制对象本身 + 所有嵌套对象(递归复制) |

| 引用类型字段 | 复制的是引用地址(指向同一块内存) | 真正 new 出新对象(完全独立) |

| 修改影响 | 修改新对象的引用字段,会影响原对象 | 新旧对象完全独立,互不影响 |

| 实现难度 | 非常简单(默认 clone() 就是浅拷贝) | 较复杂(需要递归处理所有引用) |

| 性能 | 快 | 慢(要 new 很多对象) |

| 典型场景 | 基本够用,对象里只有基本类型 | 对象里有集合、数组、自定义对象等引用类型 |

| 方式 | 是深拷贝还是浅拷贝? | 说明 |

|---|---|---|

| 对象的 clone() 方法 | 浅拷贝 | 默认只复制引用 |

| new 对象 + 手动赋值 | 可深拷贝 | 最常用 |

| 序列化 + 反序列化 | 深拷贝 | 最彻底(连 final 都行) |

| Apache BeanUtils.copyProperties | 浅拷贝Conditional | 常用但很多人误以为是深拷贝 |

| JSON 序列化(如 FastJSON、Gson) | 深拷贝 | 简单粗暴,生产常用 |

“浅拷贝只复制对象和引用地址,引用字段共用同一块内存,改一个另一个也变; 深拷贝递归复制所有层级,新对象和原对象完全独立,互不影响。 Java 中 clone() 默认是浅拷贝,真正深拷贝常用序列化或手动递归实现。”

Person p1 = new Person("张三", 18, new Address("北京"));

// 1. 手动拷贝(推荐)

Person p2 = new Person(p1.getName(), p1.getAge(), new Address(p1.getAddress().getCity()));

// 2. clone 浅拷贝

Person p3 = (Person) p1.clone();

// 3. 拷贝构造器(最优雅)

Person p4 = new Person(p1); // 自己写一个构造器 Person(Person other)

// 4. 序列化深拷贝(最彻底)

Person p5 = SerializeUtils.deepClone(p1); // 工具类封装

// 5. JSON 深拷贝(生产最常用)

Person p6 = gson.fromJson(gson.toJson(p1), Person.class);

// 6. BeanUtils 浅拷贝(慎用)

BeanUtils.copyProperties(p1, new Person());

// 7. Spring BeanUtils

org.springframework.beans.BeanUtils.copyProperties(p1, new Person());

// 8. 第三方工具

Person p8 = DeepCopy.utils.deepCopyByGson(p1);

“Java 拷贝最常用 3 种:

- 手动 new(最清晰)

- JSON 序列化(最省事 + 深拷贝)

- 序列化(最彻底) 其他如 clone、BeanUtils 都是浅拷贝,生产慎用。”

35、在自己的代码中,如果创建一个java.lang.String类,这个类是否可以被类加载器加载?为什么。

因为 java.lang 包是 Java 核心包,受 JVM 特殊保护,普通应用程序代码不允许定义 java.lang 包下的类,任何试图加载 java.lang. 中类的行为都会被类加载器直接拒绝。

36、说一说你对java.lang.Object对象中hashCode和equals方法的理解。在什么场景下需要重新实现这两个方法。

“equals 相等 → hashCode 必须相等”,这是 Java 哈希容器(HashMap、HashSet、HashTable)能正常工作的基石。

| 方法 | 官方规定(必须背下来) | 违反会怎样? |

|---|---|---|

| equals() | 1. 自反性:x.equals(x) → true 2. 对称性:x.equals(y) → y.equals(x) 也必须 true 3. 传递性:x.equals(y) && y.equals(z) → x.equals(z) 4. 一致性:多次调用结果一致 5. x.equals(null) → false | 违反对称性/传递性 → HashMap/HashSet 行为异常 |

| hashCode() | 1. 多次调用返回相同值(只要对象没被修改) 2. 如果 a.equals(b) → a.hashCode() 必须等于 b.hashCode() 3. 不相等时 hashCode 可以相同(但最好不同,提升哈希表性能) | 违反第2条 → 放进 HashMap 后找不到对象! |

1>默认实现到底长什么样?

// Object 类的默认实现(源码)

public boolean equals(Object obj) {

return (this == obj); // 直接比较引用地址

}

public native int hashCode(); // native 方法,返回对象在内存中的地址(或地址转换值)

- 默认 equals 就是 ==

- 默认 hashCode 基本和对象内存地址挂钩(同一个对象永远相同,不同对象大概率不同)

2>什么时候必须重写这两个方法?

| 场景 | 为什么必须重写? | 典型例子 |

|---|---|---|

| 1. 对象要放进 HashMap/HashSet 做 key 或元素 | 业务上认为“内容相同就是同一个对象”,但默认是按地址判断 → 找不到! | 实体类(User、Order) |

| 2. 业务语义相等(logical equality) | 比如两个 User(id=1, name=”张三”) 认为是同一个 | 所有实体类 |

| 3. 用作缓存的 key | 缓存 key 必须内容相等就能命中 | Redis 缓存、Guava Cache |

| 4. 集合去重(list → set) | 想根据业务字段去重而不是地址去重 | List |

| 5. 框架要求(JPA/Hibernate 实体) | @Entity 必须正确实现 equals/hashCode,否则多对一、一对多关系会乱 | JPA 实体类 |

“只要对象会被放进 HashMap、HashSet、HashTable 做 key 或元素,或者需要业务含义相等,就必须同时重写 equals 和 hashCode。”

| 坑 | 后果 | 正确做法 |

|---|---|---|

| 只重写 equals,不重写 hashCode | 放进 HashMap 找不到对象 | 必须一起重写 |

| 用可变字段(如 List、name)参与 equals | 修改字段后从 HashMap 找不到原对象 | 只用不可变业务主键(id) |

| 用 instanceof 代替 getClass() | 违反对称性/传递性(子类问题) | 永远用 getClass() |

| 用 Lombok @EqualsAndHashCode 没加参数 | 子类不继承父类字段,导致 id 不参与 | 父类加 @EqualsAndHashCode(callSuper = true) |

“Object 的 equals 默认是 ==,hashCode 默认返回内存地址。

这两个方法是 HashMap/HashSet 等哈希容器正常工作的基石,核心契约是:equals 相等的两个对象必须拥有相同的 hashCode。

当我们把对象用作 HashMap 的 key、HashSet 的元素,或者需要业务含义相等时,就必须同时重写这两个方法。

重写时推荐基于业务主键(如 id)+ getClass() 来实现,避免使用可变字段和 instanceof,确保满足对称性、传递性和一致性。”

3>正确重写

@Entity

@Getter @Setter

public class User {

private Long id;

private String username;

private String email;

// 推荐:只基于业务主键(通常是 id)

@Override

public boolean equals(Object o) {

if (this == o) return true;

if (o == null || getClass() != o.getClass()) return false; // 关键!防止子类问题

User user = (User) o;

return Objects.equals(id, user.id);

}

@Override

public int hashCode() {

return Objects.hash(getClass(), id) //更严谨

}

}

37、实体类的equals和hashCode方法是否可以完全交给Lombok的@Data注解实现?需要注意什么地方?

实体类的equals和hashCode方法可以通过Lombok的@Data注解来自动生成。使用@Data注解时,Lombok会为类生成equals()和hashCode()方法,这些方法将基于类中的字段来实现。

需要注意的是,当使用@Data注解时,默认情况下,Lombok生成的equals()和hashCode()方法只会考虑当前类的字段,而不会考虑超类(父类)的字段。如果你的类继承自另一个类,并且你希望在equals()和hashCode()方法中包含超类的字段,你需要在@EqualsAndHashCode注解中设置callSuper属性为true。如果不设置callSuper为true,而你的超类中有重要的字段,那么Lombok生成的方法可能不会正确地处理这些字段,这可能会导致意外的行为。

Lombok实现equals和hashCode的方式是,它会为类中的每个非静态(non-static)和非瞬态(non-transient)字段生成相应的代码。默认情况下,所有这些字段都会被包含在生成的方法中,除非你使用@EqualsAndHashCode.Exclude注解来显式排除某些字段,或者使用@EqualsAndHashCode.Include来显式包含某些字段。

此外,如果类中已经存在与Lombok将要生成的方法同名的方法,Lombok不会生成新的方法,也不会发出警告或错误。如果你需要为equals()和hashCode()方法设置非默认的参数,比如callSuper,你可以显式地添加@EqualsAndHashCode注解,并设置相应的参数,@Data注解会智能地推迟到这些显式注解。

总结来说,Lombok的@Data注解可以自动实现实体类的equals和hashCode方法,但在使用时需要注意超类字段的处理以及可能需要的字段包含或排除。

38、那为什么 JPA 实体建议不要用 Lombok 的 @EqualsAndHashCode?

| 序号 | 致命问题(踩中就死) | 具体表现 / 事故案例 | 正确做法 |

|---|---|---|---|

| 1 | 懒加载代理对象导致 equals 永远不等(最常见最致命!) | User 实体有关联的 orders(@OneToMany(fetch = LAZY)) 从数据库查出来的是 Hibernate 代理对象(User$$_jvst123_0) getClass() 变成代理类 → 两个 User 实例 getClass() 不同 → equals 永远返回 false → HashSet 重复、缓存失效 | 手动写 equals + getClass(),或者用业务主键(id) |

| 2 | 未持久化的实体(id 为 null)导致 equals 行为不一致 | 新建一个 User u1 = new User(“张三”) u2 = new User(“张三”) id 都是 null → equals(true) → 放进 HashSet 变成一个 保存后 id 变成 1 和 2 → 突然 equals(false) → HashSet 里还是只有一个 → 找不到对象! | 永远只用 id 判断相等,未保存的实体不要放集合 |

| 3 | 集合中的实体被修改后从 Set 中“丢失”(经典事故) | Set |

实体 equals/hashCode 只能基于不可变的业务主键(通常是 id) |

| 4 | 双向关系导致 StackOverflowError(循环引用) | User 和 Department 双向关联 @EqualsAndHashCode → equals 调用 department.equals → 再调用 user.equals → 无限递归 → 栈溢出 | 手动写时排除对方字段,或用 @EqualsAndHashCode.Exclude |

| 5 | 违反 JPA 规范建议(官方文档写死了) | JPA 规范明确建议:“实体 equals/hashCode 实现应该基于业务主键,不建议使用 Lombok 等自动生成工具” Hibernate 官方文档也专门写了警告 | 手动写,或者用 @NaturalId + 专用工具 |

“JPA 实体用 Lombok @EqualsAndHashCode = 线上事故制造机!

因为懒加载代理、id 为 null、字段可变、循环引用四大天坑,

大厂 + 官方都禁止,必须手动基于 id 实现 equals/hashCode,一点不能偷懒!”

- “在 JPA 实体中,equals 必须用 getClass() 而不是 instanceof, 对应的 hashCode 也必须写成 Objects.hash(getClass(), id), 否则不同实体类但 id 相同时 hashCode 会相同, 导致 HashMap/HashSet 行为异常,出现对象被覆盖、缓存穿透等严重 bug。 这是 JPA 实体实现 equals/hashCode 的终极最佳实践,大厂强制要求!”

- “在 JPA 实体里写 equals,instanceof 是雷区,getClass() 是保险箱。 因为要满足对称性、传递性,还要防 Hibernate 代理对象,只能用 getClass() + 业务主键(通常是 id)。”

Lombok 的 @EqualsAndHashCode 默认使用 instanceof + 所有字段

39、在jdk1.5中,引入了泛型,泛型的存在是用来解决什么问题。

“JDK 1.5 引入泛型,最根本的目的就是解决集合的类型安全问题, 把原来只能在运行时发现的 ClassCastException 提前到编译期暴露出来,

40、这样的a.hashcode() 有什么用,与a.equals(b)有什么关系。

“hashCode() 是为了让对象能又快又准地放进 HashMap、HashSet 这类哈希容器,而 equals() 是最终判断两个对象是否真的相等。 Java 官方规定了一个永远不能违背的生死契约: equals 相等的两个对象,hashCode 必须 100% 相等! 反过来,hashCode 相等的两个对象,equals 可以相等也可以不相等。”

41、有没有可能2个不相等的对象有相同的hashcode。

“完全有可能,而且必然会发生! 两个不相等的对象拥有相同的 hashCode 叫哈希冲突,是正常现象, Java 官方规范明确允许,HashMap/HashSet 也完全能正确处理。 只要满足‘equals 相等 → hashCode 一定相等’这条铁律就行, 反过来 hashCode 相等并不要求 equals 一定相等。”

42、Java中的HashSet内部是如何工作的。

它内部持有一个 HashMap,添加元素时把元素作为 key,value 永远是一个固定的占位对象 PRESENT。 所有操作(增、删、查、判重)本质上都是对底层 HashMap 的 key 进行操作。 HashSet 的去重、快速查找、O(1) 性能全部来源于 HashMap 的哈希表实现,

HashSet.add("hello")

↓

HashMap.put("hello", PRESENT) ← 真正执行的是这一步

↓

1. 计算 "hello".hashCode() → 得到一个 int 值

2. 通过 (hash & (table.length-1)) 定位到哪个桶(bucket)

3. 桶里如果有对象 → 挨个 equals 比较

- 找到 equals 为 true 的 → 返回旧值(说明已存在)

- 没找到 → 插入新节点,返回 null(说明添加成功)

4. HashSet 的 add 方法判断 map.put() 返回 null → 返回 true(添加成功)

43、java8的新特性。

| 排名 | 特性 | 一句话解释 | 生产中最常用场景(必背) |

|---|---|---|---|

| 1 | Lambda 表达式 | 让代码变成“函数式”,告别匿名内部类 | 集合操作、线程池、Stream、事件监听 |

| 2 | Stream API | 管道式处理集合,像 SQL 一样写业务代码 | 列表过滤、分组、排序、聚合(最常用!) |

| 3 | 函数式接口 | 只有一个抽象方法的接口(@FunctionalInterface) | Runnable、Comparator、Predicate、Function、Consumer |

| 4 | 默认方法(default) | 接口可以有带方法体的方法,解决接口升级问题 | Collection.stream()、List.sort() 全靠它 |

| 5 | 方法引用 :: | Lambda 的语法糖,更简洁 | System.out::println、User::new、String::valueOf |

| 6 | Optional 类 | 优雅解决 NPE(空指针)问题 | 替代 if(obj!=null)、链式取值、返回值防空 |

| 7 | 新的日期时间 API | 线程安全、设计合理,终于干掉老 Date/Calendar | LocalDateTime、ZonedDateTime、Duration |

| 8 | 并行流 parallelStream | 多核 CPU 轻松并行处理大数据集合 | 大集合统计、批量处理(谨慎使用,注意线程安全) |

| 9 | Nashorn JavaScript 引擎 | 可在 Java 中直接运行 JS(Java 15 已移除) | 少用,基本淘汰 |

| 10 | MetaSpace 取代 PermGen | 永久代改成元空间,用本地内存,不再 OOM | JVM 调优不再调 -XX:MaxPermSize |

| 问题 | 标准回答(直接背) |

|---|---|

| 你最喜欢 Java 8 的哪个特性? | Stream + Lambda,让代码量减少 50%+,可读性爆表 |

| parallelStream 有没有坑? | 有!线程不安全、数据量小反而更慢、有序性可能丢失 |

| default 方法解决什么问题? | 接口升级时兼容老实现(比如 java 8 给 Collection 加了 stream()) |

| Optional 是万能的吗? | 不是!不能替代所有 null 判断,滥用反而代码更丑 |

44、什么是序列化,怎么序列化,为什么序列化,反序列化会遇到什么问题,如何解决。

| 问题 | 标准答案(直接背) |

|---|---|

| 什么是序列化? | 把 Java 对象转换成字节数组(byte[])的过程。反过来,把字节数组恢复成 Java 对象叫反序列化。 |

| 怎么序列化? | 1. 类实现 Serializable 接口(标记接口,无方法) 2. 用 ObjectOutputStream.writeObject(obj) 写出去 3. 用 ObjectInputStream.readObject() 读回来 |

| 为什么需要序列化?(5 大真实场景) | 1. 对象网络传输(RPC、RMI、Socket) 2. 对象持久化到文件/数据库(缓存快照、日志) 3. 深拷贝(最彻底的深拷贝方式) 4. 分布式系统传递(Redis 缓存、Kafka 消息、Dubbo 参数) 5. Android Parcelable 底层也是序列化 |

| 反序列化会遇到什么问题?(8 大坑,线上事故常客) | 1. serialVersionUID 不一致 → InvalidClassException 2. 类结构改变(删了字段、改了类型)→ 反序列化失败 3. transient 字段丢失(不参与序列化) 4. 静态字段不序列化 5. 父类没实现 Serializable → 父类字段全部丢失 6. 循环引用 → 正常(JVM 自动处理) 7. 反序列化时执行恶意代码(黑客攻击神器) 8. 单例/枚举被破坏 |

| 如何解决这些问题?(生产级最佳实践) | 见下表(背完无敌) |

| 问题 | 解决方案(必写) | 代码示例 |

|---|---|---|

| serialVersionUID 不一致 | 显式声明 private static final long serialVersionUID = 1L;(推荐用 IDEA 自动生成) | 是 |

| 类结构变化 | 1. 永远不要删字段,只加新字段 2. 用 defaultReadObject + 手动兼容老字段 3. 推荐用 JSON 替代 | 是 |

| transient 字段丢失 | 想序列化就别加 transient,想控制就自己写 writeObject/readObject | 是 |

| 父类没实现 Serializable | 父类也加上 Serializable,或子类自己手动序列化父类字段 | 是 |

| 防止反序列化破坏单例 | 实现 readResolve() 方法返回单例实例 | 是 |

| 防止反序列化执行恶意代码 | 1. 不要反序列化不可信数据 2. 用 ObjectInputFilter(JDK 9+) 3. 生产推荐用 JSON/FastJSON | 是 |

| 深拷贝最彻底方式 | 序列化 + 反序列化就是最彻底的深拷贝(连 final 字段都能拷贝) | 是 |

终极结论(面试/架构师必背 3 句话)

- “Java 序列化就是把对象转成字节数组,用于网络传输、持久化、深拷贝,是分布式系统的基石。”

- “反序列化最大风险是 serialVersionUID 不一致和安全漏洞,生产环境必须显式声明 serialVersionUID,严禁反序列化不可信数据。”

- “2025 年大厂趋势:新项目一律禁止用 Java 原生序列化,全部改用 JSON(FastJSON2/Jackson)或 Protostuff,性能更高、更安全、跨语言。”

45、Java基础

| 类别 | 内容 |

|---|---|

| 基本类型 | byte, short, int, long, float, double, char, boolean |

| 引用类型 | 类、接口、数组、枚举、注解 |

| 集合接口 | List, Set, Queue, Deque, Map |

| 常用集合类 | ArrayList, LinkedList, HashSet, TreeSet, HashMap, LinkedHashMap, ConcurrentHashMap 等 |

1.面向对象编程的特性?

封装、继承、多态

2.四大修饰符和作用范围

- public

- 当前类、同一包、不同包子类、其他包

- protected

- 当前类、同一包、同一包子类

- default

- 当前类、同一包

- private

- 当前类

3.基础数据类型

| 类型 | 占用字节 | 占用位数 | 默认值 | 包装类 |

|---|---|---|---|---|

| byte | 1 | 8 | 0 | Byte |

| short | 2 | 16 | 0 | Short |

| int | 4 | 32 | 0 | Integer |

| long | 8 | 64 | 0L | Long |

| float | 4 | 32 | 0.0f | Float |

| double | 8 | 64 | 0.0d | Double |

| char | 2 | 16 | ‘\u0000’ | Character |

| boolean | 1(理论上) | 无明确 | false | Boolean |

4.引用类型

类、接口、数组、枚举、注解

Class, Interface, Array, Enum, Annotation

5.主要接口

| 接口 | 描述 | 有序 | 是否重复 | 是否允许Null |

|---|---|---|---|---|

| Collection | 所有集合的根接口 | - | - | - |

| List | 有序集合 | 是(插入顺序) | 是 | 是 |

| Set | 无序集合,不允许重复 | 否 | 否 | 部分允许 |

| Queue | 队列 | 是 | 是 | 是 |

| Deque | 双端队列 | 是 | 是 | 是 |

| Map | 键值对映射 | 否 | 键否,值是 | 部分允许 |

1 >List

- ArrayList-动态数组

- LinkedList-双向链表

- Vector-动态数组-线程安全

- 过时,性能差

- CopyOnWriteArrayList-写时复制数组

- 读多写少并发场景

2>Set

| 类 | 底层结构 | 特点 |

|---|---|---|

HashSet |

哈希表 | 无序,快速,允许 1 个 null |

LinkedHashSet |

哈希表 + 链表 | 保持插入顺序 |

TreeSet |

红黑树 | 有序(自然顺序或 Comparator),不允许 null |

3>Queue

| 类 | 特点 |

|---|---|

PriorityQueue |

堆结构,优先级队列(最小/最大堆) |

ArrayDeque |

数组实现双端队列,推荐使用 |

4>Map

| 类 | 底层数据结构 | 特点 |

|---|---|---|

| HashMap | 数组+链表/红黑树 | 无序,允许 1 个 null 键,多个 null 值 |

| LinkedHashMap | 哈希表和链表 | 保持插入顺序或访问顺序(LRU) |

| TreeMap | 红黑树 | 键有序(自然顺序或 Comparator),不允许 null 键 |

| HashTable | 哈希表 | 过时,不允许 null,性能差 |

| ConcurrentHashMap | 分段锁/节点锁 | 高并发场景 |

| Properties | HashTable子类 | 常用于配置文件 |

-

所有集合类都是 引用类型,存储在堆中。

-

基本类型可以通过 自动装箱/拆箱 与包装类互转:

Integer i = 10; // 自动装箱 int j = i; // 自动拆箱 -

集合操作泛型推荐使用包装类,避免

NullPointerException。

46、JAVA怎么保证线程安全?

需要三个属性,可见性、有序性、原子性

- 同步机制

- Synchronized

- lock

- volatile

- 可见性

- 有序性

- CAS + 原子类

- 保证无锁原子操作

- 线程安全数据结构

- 不可变对象设计

- 线程隔离技术

- ThreadLocal

| 锁状态 | 状态标志 (Mark Word) | 触发条件 | 核心机制 | 性能特点 |

|---|---|---|---|---|

| 1. 偏向锁 | 101 | 只有一个线程第一次尝试获取锁。 | 存储线程 ID。 | 最快,几乎没有开销。 |

| 2. 轻量级锁 | 00 | 偏向锁被另一个线程获取,但没有并发竞争。 | CAS 替换 Mark Word 指针。 | 较快,适用于线程交替执行。 |

| 3. 重量级锁 | 10 | 多个线程同时竞争轻量级锁(CAS 失败)。 | 操作系统 Mutex (Monitor)。 | 最慢,需要进行线程上下文切换。 |

47、ThreadLocal的原理?注意点

并发编程的一个工具类,实现让每个线程都有自身独立的变量副本,从而线程之间的数据隔离的机制。

注意内存泄漏风险,适用于线程隔离数据场景

ThreadLocal.get()先获取当前线程的ThreadLocalMap,以当前ThreadLocal对象为key进行存取。ThreadLocalMap使用开放地址法解决哈希冲突。[ThreadLocal数量少(几十个),冲突概率极低,开放寻址更快+省内存]

- 计算初始位置i

- 从i开始线性探测

- 遇到key匹配:返回value

- 遇到key=null:调用expungeStaleEntry(i)清理,但继续从i+1位置探测

- 遇到null槽:返回null(未找到)

内存泄漏

- 内存泄漏因ThreadLocalMap的key是弱引用,ThreadLocal对象被回收后key为null,但value强引用无法回收,需手动remove()。

弱引用key确保当ThreadLocal外部强引用消失时,ThreadLocal对象本身可被GC回收,降低内存泄漏严重性。

48、事务中的一致性和分布式系统中的一致性是一样的吗

考察点:ACID特性,CAP定理,概念辨析能力

不一样。事务ACID中的C(Consistency)指数据在事务执行前后必须满足所有预定义的业务规则和完整性约束(如外键、唯一索引),是数据库内部的“状态正确性”。而分布式系统中的C(Consistency)指在分布式系统的多个节点之间,数据在同一时刻的“副本一致性”,即所有节点在同一时间点看到的数据是相同的。

49、Array的底层结构

在Java中,Array的底层是一块连续的内存空间,存储相同类型的元素。通过索引直接计算内存偏移量访问元素,时间复杂度O(1)。数组长度固定,创建后不可改变。

数组是连续内存块,通过索引直接寻址,长度固定。

50、HashMap TreeMap的底层原理,是否安全

HashMap是基于数组+链表/红黑树实现的无序键值对数据集合;O(1)

TreeMap是基于红黑树实现的有序键值对集合;查找O(log n)

HashMap为什么选择红黑树而不是AVL树?(红黑树旋转次数少,插入删除性能更好)

LinkedHashMap继承自HashMap,在HashMap数组+链表/红黑树的基础上,额外维护了一个贯穿所有元素的双向链表。这个链表可以保持元素的插入顺序或访问顺序,而HashMap不保证任何遍历顺序。

51、不同JDK的特性

- JDK8 Lambda原理:基于invokedynamic指令,运行时生成匿名类,非语法糖而是编译器魔法

- Lambda原理:基于invokedynamic指令,运行时动态生成匿名类,非简单的语法糖

- Stream API (java.util.stream) 为集合数据处理提供了一种全新且强大的方式,支持链式操作和并行处理。

- JDK11 ZGC原理:基于染色指针的并发垃圾收集器,暂停时间不超过10ms,适用大内存

- JDK17密封类原理:通过sealed和permits关键字在编译期限制类继承,增强领域建模能力

- JDK21虚拟线程原理:用户态线程,由JVM调度而非操作系统,大幅提升并发性能

52、ConcurrentHashMap

JDK7采用分段锁(Segment),JDK8+改为数组节点锁(Node)

基于数组+链表/红黑树的结构,通过CAS+Synchronized 实现分段锁,支持高并发读写,通过sizeCtl控制扩容,transfer方法多线程协调数据迁移,是线程安全和高性能的HashMap的实现

为什么JDK8放弃分段锁改用synchronized?

(synchronized在JDK6后性能大幅提升,锁粒度更细,内存开销更小)

ConcurrentHashMap在扩容时如何保证线程安全?

(通过ForwardingNode标记迁移节点,多线程协作迁移,每个线程处理不同区间)

CAS

Compare-And-Swap比较并交换,乐观锁机制,失败时重试

- 数组初始化:初始化table时使用CAS保证只初始化一次

- 空桶插入:向空桶插入头节点时使用CAS,避免锁开销

- 空桶插入只有单一状态变更(null→node),CAS可原子完成。非空桶操作涉及多步骤(遍历、比较、插入),需要synchronized保证原子性。

- 计数器更新:size计数使用CounterCell数组+CAS,避免单一计数器瓶颈

自旋

CAS在值不匹配时自旋,默认无限重试但实际受竞争程度限制。

伪共享问题

核心原因在于伪共享(False Sharing)问题导致的性能瓶颈。

AtomicLong 的局限性:伪共享

AtomicLong 使用 CAS 来更新一个单独的、全局的 long 变量。在高并发场景下,即使不同的线程在不同 CPU 核心上运行,它们频繁地争抢同一个内存地址(AtomicLong 实例)的修改权。

这会导致伪共享

CounterCell避免单一AtomicLong的缓存行伪共享和CAS竞争瓶颈。优先尝试低开销的全局更新(baseCount),冲突时再切换到高开销但能有效避免伪共享的分散式更新(CounterCell 数组)。

- 数据结构:

ConcurrentHashMap内部维护一个CounterCell[]数组 (cells)。 - 分散热点:当需要更新大小时,系统会根据当前线程的哈希值,将操作分散到

cells数组的不同位置。这大大降低了多个线程争抢同一个内存位置的概率。 - 避免伪共享:

CounterCell类被特殊设计过,它内部包含 15 个long类型的填充字段,将实际存储计数的value字段“隔离”在自己的缓存行中。这些填充字段占据了额外的 120 字节(8 bytes * 15),确保一个CounterCell实例独占一个或多个缓存行,从而避免与其他变量产生伪共享。ConcurrentHashMap中CounterCell[]数组的长度(cells.length)是动态调整的,取决于 CPU 核心数和并发竞争程度:- 懒初始化:数组最初是

null。 - 动态扩容:当并发冲突发生时,数组会被初始化,通常从一个较小的长度开始(例如 2 或 4)。随着冲突的增加,数组会进行两倍扩容。

- 最大长度限制:

cells数组的长度不会无限增长。它通常最大限制为CPU 核心数的两倍(由源码中的常量控制,例如 64 个槽位)。

- 懒初始化:数组最初是

- 汇总:当需要获取总大小时(调用

size()方法),它会将cells数组中所有CounterCell的值以及一个基准值baseCount加起来。

53、AtomicInteger

对JAVA标准类型int的原子封装

核心特点:

- 线程安全和原子性

AtomicInteger确保了所有操作(如增加、减少、设置新值)都是原子性的,这意味着它们要么完全执行成功,要么完全不执行,不会出现中间状态。

- 基于CAS实现

- 它通过硬件级别的 CAS 指令保证操作的原子性,避免了线程阻塞和上下文切换的开销。

54、内存溢出和内存泄漏

- 内存溢出 (Out Of Memory, OOM)

内存溢出指的是程序在申请内存时,没有足够的内存空间供其使用。JVM 抛出著名的 java.lang.OutOfMemoryError 错误。

特点:

- 结果:应用程序彻底崩溃,JVM 无法继续运行。

- 原因:是物理空间的不足。可能是堆内存(Heap Space)不足、栈内存(Stack Space)不足、元空间(Metaspace)不足等。

- 通常表现:

java.lang.OutOfMemoryError: Java heap space(堆内存不足,最常见)。java.lang.OutOfMemoryError: PermGen space或Metaspace(永久代或元空间不足,类定义过多)。java.lang.OutOfMemoryError: Unable to create new native thread(创建线程过多,导致栈内存不足)。

示例场景:

分配了一个过大的数组,或者加载了过多的图片、视频等大型对象,超出了 JVM 堆内存的限制。

- 内存泄漏 (Memory Leak)

内存泄漏指的是程序在运行过程中,分配的内存无法被 JVM 的垃圾回收器(GC)回收,即使这块内存已经不再被程序使用。

特点:

- 结果:程序可以继续运行,但随着时间的推移,可用的内存越来越少。这是一个累积过程。

- 原因:是垃圾回收机制失效,GC 认为对象仍然“可达”(reachable),有强引用指向它,但实际上程序代码已经不再需要使用它了。

- 最终影响:内存泄漏最终会导致内存溢出。泄漏到一定程度,剩余的可用内存耗尽,就会触发 OOM。

示例场景:

- ThreadLocal 误用:如前所述,忘记调用

remove()导致 Value 对象无法释放。 - 静态集合类:将对象放入一个静态的

ArrayList或HashMap中,但从不移除,导致对象常驻内存。 - 未关闭的连接:数据库连接、网络连接、文件流等未正确关闭,导致相关缓冲区和对象无法释放。

核心区别总结

| 特性 | 内存溢出 (OOM) | 内存泄漏 (Memory Leak) |

|---|---|---|

| 定义 | 没有足够的内存可用 | 内存无法被 GC 回收 |

| 现象 | 立即崩溃,抛出 Error |

运行缓慢,内存逐渐耗尽 |

| 原因 | 物理空间不足 | 存在无效但未释放的引用 |

| 关系 | 内存泄漏的结果是内存溢出 | 内存溢出可能是内存泄漏导致的 |

55、reentrantlock和reentrantreadwritelock的区别

| 特性 | ReentrantLock |

ReentrantReadWriteLock |

|---|---|---|

| 锁类型 | 排他锁 (独占锁) | 读写锁 (读共享,写独占) |

| 并发性 | 低。任何操作都互斥。 | 高。允许多个线程同时读。 |

| 内部锁结构 | 单一的 Lock 对象 |

两个嵌套的 Lock 对象 (ReadLock 和 WriteLock) |

| 适用场景 | 读写均衡,或写操作频繁 | 读操作远多于写操作 |

| 性能提升 | 提供互斥性,性能类似于 synchronized |

在高并发读场景下性能显著优于 ReentrantLock |

ReentrantLock 是独占锁,一次只允许一个线程访问共享资源,适用于写操作多或读写混合但不关注读并发的场景。 ReentrantReadWriteLock 是读写锁,允许多个线程同时读,提高读多写少场景的并发性能,写操作独占。当我们有大量读操作且写操作相对较少时,使用读写锁可以显著提高吞吐量。但在写操作频繁时,读写锁可能导致写线程长时间等待,所以需要根据场景选择。

只要你还拿着写锁 → 其他线程连读都不允许 → 所以你自己“可以直接读”,但全世界只有你一个人能读!(/写锁直接读,绝对没问题)

只有在你“再拿一次读锁 + 先释放写锁”之后,其他线程才被允许进来读! 这就是锁降级的真正意义。

writeLock.lock();

cache.put(...);

readLock.lock(); // 先给自己再拿一个读锁(当前线程允许)

writeLock.unlock(); // 写锁放掉,让别人进来读

// 此时你自己还持有一个读锁,后续继续读完全不阻塞!

56、线程池的原理

🎯 线程池(Thread Pool)的实现原理